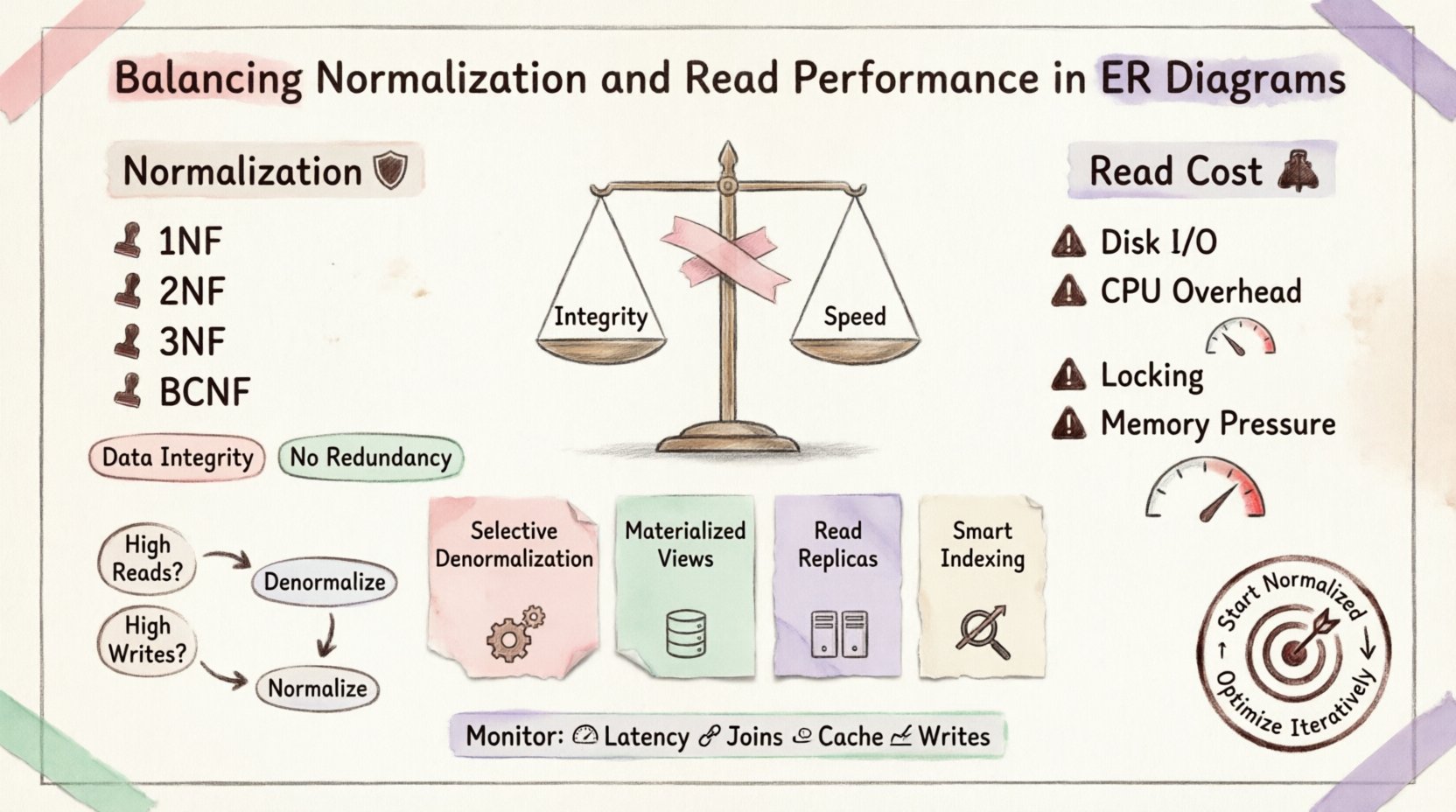

Projetar um esquema de banco de dados raramente é uma escolha binária entre velocidade e estrutura. É um exercício de compromisso. Quando arquitetos constroem Diagramas Entidade-Relacionamento (DERs), frequentemente enfrentam a tensão entre a integridade rigorosa dos dados e a velocidade bruta necessária para aplicações de alto volume. A normalização minimiza a redundância, garantindo que os dados permaneçam consistentes. No entanto, o custo de manter essa consistência é frequentemente pago em desempenho de leitura.

Este artigo explora os detalhes técnicos desse equilíbrio. Analisaremos como a normalização afeta as junções, como cargas de trabalho intensivas em leitura determinam alterações no esquema e onde se traça a linha entre um banco de dados bem estruturado e um de alto desempenho.

Compreendendo a Normalização: A Fundação 🛡️

A normalização é o processo de organizar dados para reduzir a redundância e melhorar a integridade dos dados. Envolve dividir tabelas grandes em outras menores e lógicas e definir relacionamentos entre elas. O objetivo é eliminar anomalias durante inserções, atualizações e exclusões.

Formas Normais Principais

-

Primeira Forma Normal (1FN): Garante atomicidade. Cada coluna contém apenas um valor. Nenhum grupo repetido.

-

Segunda Forma Normal (2FN): Baseia-se na 1FN. Todos os atributos não-chave devem depender totalmente da chave primária. Remove dependências parciais.

-

Terceira Forma Normal (3FN): Baseia-se na 2FN. Remove dependências transitivas. Atributos não-chave dependem apenas da chave, da chave inteira e de nada além da chave.

-

Forma Normal de Boyce-Codd (FNBC): Uma versão mais rigorosa da 3FN para lidar com anomalias específicas de dependência.

Embora seguir essas formas garanta um banco de dados limpo, introduz complexidade na consulta. Cada relacionamento definido no diagrama ER torna-se uma operação de junção potencial.

O Custo das Leituras 💸

Quando você normaliza dados, frequentemente divide informações entre várias tabelas. Para recuperar um registro completo, o motor do banco de dados deve realizar operações de junção. As junções são computacionalmente custosas.

Por que as Junções Aumentam o Tempo das Consultas

-

E/S de Disco: Se as tabelas não estiverem perfeitamente indexadas ou em cache, o motor precisará buscar dados em diferentes localizações físicas no disco.

-

Carga de CPU: O banco de dados deve corresponder chaves de uma tabela a outra. Isso exige grande poder de processamento.

-

Contenção de Bloqueios: Junções complexas podem manter bloqueios por mais tempo, bloqueando outras transações de acessar dados relacionados.

-

Pressão de Memória: Operações de junção grandes exigem buffers de memória substanciais para ordenar e hashar dados.

Em um ambiente com muitas leituras, como um painel de relatórios ou uma API voltada para o público, essa latência é inaceitável. Os usuários esperam feedback instantâneo. Uma consulta que leva 100 milissegundos para retornar dados normalizados pode levar apenas 10 milissegundos se desnormalizada.

Estratégias para Otimização 🚀

Para equilibrar integridade e velocidade, arquitetos utilizam padrões específicos. Essas estratégias permitem manter o banco de dados normalizado onde mais importa, ao mesmo tempo em que otimizam as leituras onde realmente importam.

1. Desnormalização Seletiva

Nem todas as tabelas precisam ser totalmente normalizadas. Identifique os dados mais frequentemente acessados e armazene-os de forma redundante. Por exemplo, se você frequentemente consulta nomes de usuários juntamente com seu histórico de pedidos, armazenar o nome do usuário diretamente na tabela de pedidos economiza uma junção.

2. Visualizações Materializadas

Uma visualização materializada armazena o resultado de uma consulta fisicamente no disco. É essencialmente uma tabela pré-calculada. Quando os dados mudam, a visualização deve ser atualizada. Isso é ideal para agregações complexas que não precisam de precisão em tempo real.

3. Réplicas de Leitura

Separe a carga de leitura da carga de escrita. Direcione todas as operações de escrita para o banco de dados primário, que permanece normalizado. Direcione todas as operações de leitura para uma réplica. Isso permite que a réplica seja otimizada de forma diferente, talvez com mais índices ou estruturas desnormalizadas, sem afetar a integridade transacional.

4. Estratégia de Indexação

Mesmo bancos de dados normalizados podem performar bem com os índices adequados. Índices cobrindo permitem que o banco de dados atenda a uma consulta usando apenas o índice, evitando pesquisas na tabela. Índices compostos podem acelerar junções em chaves estrangeiras comuns.

Quando desnormalizar 📉

A desnormalização é uma decisão deliberada, não um estado padrão. Deve ser tomada com base em evidências de monitoramento de desempenho, e não em suposições.

|

Cenário |

Abordagem |

Raciocínio |

|---|---|---|

|

Alta Frequência de Escrita |

Mantenha Normalizado |

As atualizações são mais rápidas. Menos redundância para manter. |

|

Alta Frequência de Leitura |

Considere a Desnormalização |

Reduz junções. Tempos de recuperação mais rápidos. |

|

Consistência de Dados Crítica |

Mantenha Normalizado |

Fonte única de verdade evita desvio de dados. |

|

Relatórios e Análise |

Desnormalizar |

As agregações são complexas; pré-calculá-las ajuda. |

|

Necessidades de Escalabilidade |

Abordagem Híbrida |

Divida serviços ou use camadas de cache. |

O Trade-off: Integridade de Dados vs Velocidade ⚙️

Cada vez que você introduz redundância, corre o risco de inconsistência de dados. Se um usuário alterar seu endereço de e-mail, mas o e-mail for armazenado em ambos os Usuários mesa e o Notificações mesa, uma atualização pode falhar ou ser ignorada. Isso é conhecido como anomalia de atualização.

Para mitigar isso, a lógica da aplicação deve ser robusta. Disparadores podem garantir a consistência, mas adicionam complexidade. Alternativamente, projete o esquema de forma que os dados desnormalizados sejam derivados e imutáveis, reduzindo o risco de divergência.

Gerenciamento da Consistência

-

Lógica ao Nível da Aplicação:Escreva código que atualize todas as cópias redundantes de forma atômica.

-

Disparadores do Banco de Dados:Deixe o banco de dados aplicar as regras automaticamente. Isso mantém a lógica próxima dos dados.

-

Consistência Eventual:Aceite que os dados podem estar desatualizados por um curto período. Use trabalhos em segundo plano para sincronizar os dados redundantes.

Monitoramento e Manutenção 🔧

Um design estático não leva em conta os padrões de uso em mudança. O que funciona hoje pode se tornar um gargalo no próximo ano. O monitoramento contínuo é essencial.

Métricas-Chave para Monitorar

-

Latência de Consulta:Monitore o tempo gasto em consultas de leitura críticas.

-

Quantidade de Junções:Monitore o número de junções por consulta complexa.

-

Taxa de Acerto no Cache:Se você usar cache, verifique se ele está reduzindo efetivamente a carga do banco de dados.

-

Latência de Escrita:Garanta que a desnormalização não tenha atrasado demais as escritas.

Conclusão: Uma Decisão Contextual 🎯

Não existe um padrão universal para o design de banco de dados. O melhor diagrama ER é aquele que se adapta ao seu trabalho específico. A normalização oferece segurança; a desnormalização oferece velocidade. O objetivo é encontrar o ponto de equilíbrio.

Comece com um design normalizado para garantir a integridade dos dados. À medida que gargalos de desempenho surgirem, identifique as consultas específicas que causam atrasos. Aplique desnormalização ou cache apenas nessas áreas. Essa abordagem iterativa evita a otimização prematura e garante que o sistema permaneça manutenível ao longo do tempo.

Lembre-se de que a tecnologia evolui. Novos motores de armazenamento e otimizadores de consultas continuam reduzindo o custo das junções. Revise regularmente seu esquema com base nas capacidades atuais. O equilíbrio muda, e seu design deve mudar junto.

Ao compreender os mecanismos da normalização e as realidades do desempenho de leitura, você pode construir sistemas que sejam tanto robustos quanto responsivos. Foque nos dados, e não apenas no código.