A arquitetura do seu sistema de armazenamento de dados é frequentemente invisível para o usuário final, mas determina a reatividade de cada interação. Quando um usuário clica em um botão, a jornada desde essa ação até a resposta visual depende fortemente da rapidez com que o motor de banco de dados subjacente pode recuperar e processar informações. Essa velocidade, conhecida como latência, não é meramente uma função da capacidade de hardware ou da largura de banda da rede. Ela está fundamentalmente enraizada no próprio design da estrutura de dados.

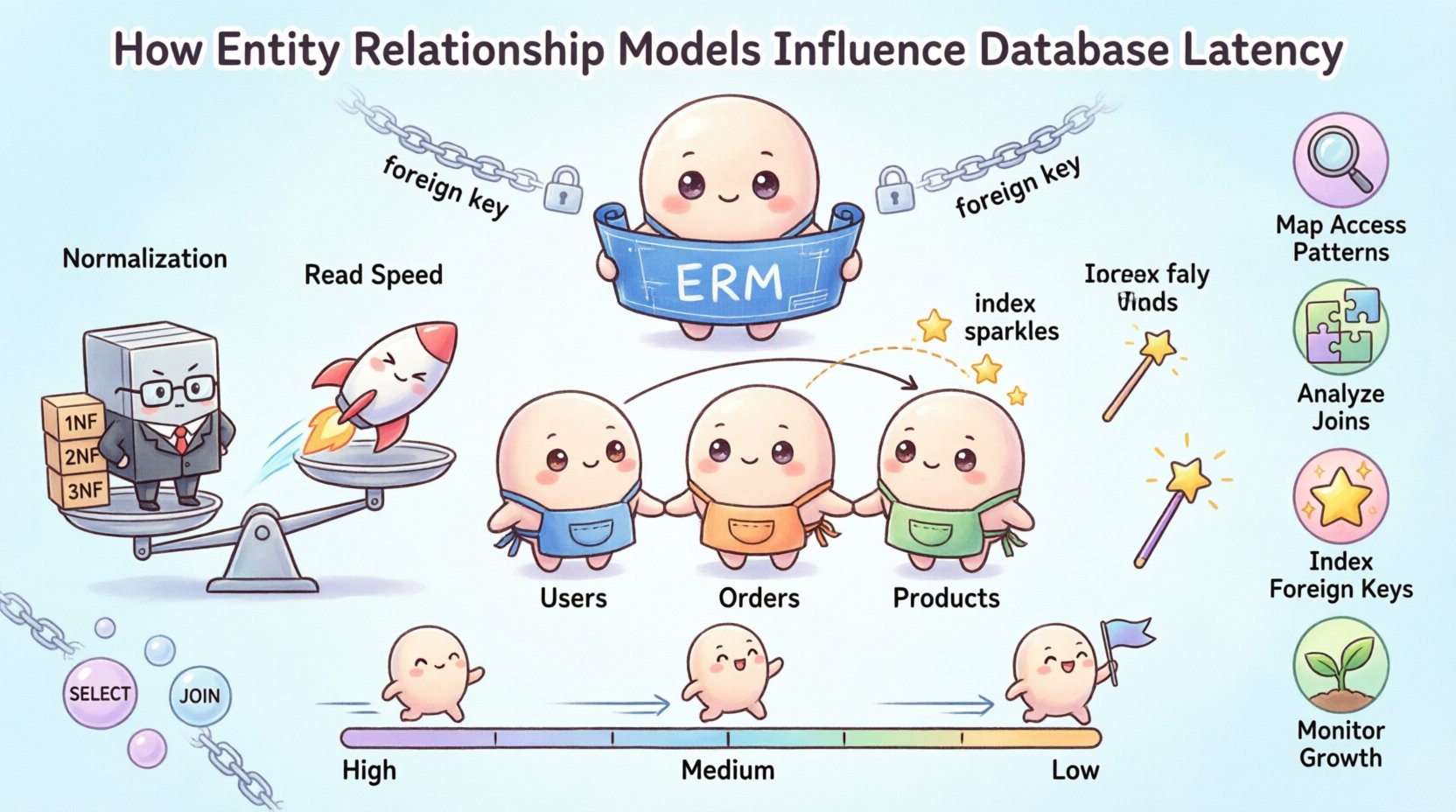

O Modelo de Relacionamento de Entidades (MRE) serve como o projeto para essa estrutura. Ele define como as entidades são armazenadas, como se relacionam entre si e como as restrições unem os dados. Um modelo mal concebido pode introduzir atritos desnecessários, fazendo com que as consultas percorram mais blocos de disco do que o necessário ou forçando o processador a realizar junções complexas que sobrecarregam o sistema. Por outro lado, um modelo bem otimizado antecipa padrões de acesso e alinha as estruturas de armazenamento às exigências das consultas.

🏗️ A Relação Central entre Esquema e Velocidade

A latência em um ambiente de banco de dados é geralmente medida em milissegundos ou microssegundos. Embora um único milissegundo possa parecer insignificante, em sistemas de alta taxa de transferência, esses atrasos se acumulam rapidamente. O Diagrama de Relacionamento de Entidades (DRE) atua como o plano lógico para o armazenamento físico. Cada linha que conecta duas entidades representa uma operação de junção potencial. Cada atributo dentro de uma entidade representa uma coluna que deve ser escaneada ou indexada.

Quando os desenvolvedores projetam um MRE, tomam decisões que afetam diretamente o plano de execução escolhido pelo motor do banco de dados. O motor depende das metadados derivadas desse modelo para determinar o caminho mais eficiente até os dados. Se o modelo sugerir uma estrutura altamente normalizada, o motor pode precisar realizar várias pesquisas para reconstruir um registro completo. Isso aumenta o número de operações de E/S necessárias.

- Projeto Lógico: Define claramente relacionamentos e restrições.

- Implementação Física: Traduz o projeto lógico em estruturas de armazenamento reais.

- Execução de Consultas: Depende das metadados fornecidas pelo esquema.

Compreender essa cadeia é crucial. Uma mudança no modelo lógico pode se propagar pela camada física, alterando como os dados são armazenados em cache, como os índices são construídos e como as transações são bloqueadas. O objetivo é equilibrar a integridade dos dados com a eficiência de recuperação.

📉 Trade-offs entre Normalização e Latência

A normalização é o processo de organizar os dados para reduzir a redundância. Embora isso garanta consistência, muitas vezes vem com o custo de desempenho de leitura. As formas padrão de normalização (1FN, 2FN, 3FN) empurram os dados para tabelas menores e mais específicas. Para recuperar uma visão completa de uma entidade, o sistema precisa unir essas tabelas.

Considere um cenário em que os detalhes dos pedidos dos clientes são armazenados em tabelas separadas. Buscar um histórico completo de pedidos exige a junção das tabelas Clientes, Pedidos, e ItensPedidos tabelas. Cada junção introduz sobrecarga de CPU e E/S de disco. Se o motor do banco de dados não conseguir utilizar um índice de forma eficaz, pode recorrer a uma varredura completa da tabela, aumentando drasticamente a latência.

Principais Impactos da Normalização

- Redução de Redundância: Menor espaço de armazenamento necessário para valores repetidos.

- Consistência: Atualizações ocorrem em um único local, reduzindo anomalias.

- Aumento de Junções: Consultas complexas exigem mais recursos computacionais.

- Fragmentação: Os dados estão espalhados por mais páginas, potencialmente aumentando o tempo de busca.

Para aplicações com alta carga de escrita, a normalização é frequentemente benéfica. Ela reduz a quantidade de dados gravados por transação. No entanto, para cargas de trabalho com alta leitura, o custo de reconstruir os dados pode se tornar um gargalo. A decisão de normalizar ou denormalizar depende inteiramente dos padrões específicos de acesso da aplicação.

🔗 Complexidade de Junção e Planos de Execução

A complexidade das relações definidas no ERD influencia diretamente a complexidade da junção. Um motor de banco de dados analisa o grafo de tabelas e relações para determinar a ordem na qual processar as junções. Em um esquema plano, isso é trivial. Em um esquema altamente relacional, o motor deve calcular a ordem de junção mais eficiente.

Quando o modelo inclui relações muitos para muitos, o sistema geralmente introduz uma tabela de ligação. Isso adiciona uma camada extra de indireção. Cada vez que você consulta essas relações, o motor deve resolver a ligação. Se as chaves estrangeiras que definem essas ligações não forem indexadas, a pesquisa se torna uma busca linear, o que é computacionalmente custoso.

Tipos de Junção e Desempenho

| Tipo de Junção | Impacto na Latência | Caso de Uso |

|---|---|---|

| Inner Join | Baixo a Médio | Recuperando apenas registros correspondentes. |

| Left/Right Join | Médio | Recuperando todos os registros de um lado, correspondência do outro. |

| Cross Join | Alto | Produtos cartesianos; raramente usados em produção. |

| Self Join | Alto | Junção de uma tabela consigo mesma para dados hierárquicos. |

Minimizar o uso de junções complexas é uma estratégia principal para reduzir a latência. Isso frequentemente envolve repensar o ERD para achatamento de dados quando apropriado. No entanto, isso deve ser feito sem comprometer a integridade lógica do modelo de dados.

📎 Estratégias de Indexação Baseadas no ERD

O ERD determina onde os índices devem ser colocados. Chaves estrangeiras são o candidato mais comum para indexação. Quando uma tabela referencia outra, a coluna de relacionamento torna-se uma rota de pesquisa crítica. Sem um índice nessa chave estrangeira, toda atualização na tabela pai exige uma varredura na tabela filha para verificar violações de restrição.

Além disso, a cardinalidade da relação afeta a estratégia de indexação. Uma relação um para muitos sugere que o índice no lado muitos (o filho) terá muitos valores duplicados. Uma relação muitos para muitos envolve uma tabela de junção que exige índices compostos para funcionar de forma eficiente.

- Chaves Primárias:Sempre indexadas para identificação rápida de linhas.

- Chaves Estrangeiras:Críticas para o desempenho de junção e aplicação de restrições.

- Chaves Compostas: Útil para consultas que filtram em múltiplas colunas.

- Índices Cobertores: Inclua todos os dados necessários para uma consulta, para evitar pesquisas na tabela.

O excesso de índices também é um risco. Cada índice consome armazenamento e desacelera as operações de escrita, pois o banco de dados deve atualizar a estrutura do índice junto com os dados. O ERD ajuda a identificar quais relacionamentos são consultados com frequência, orientando a colocação desses índices.

⚙️ Restrições de Chave Estrangeira e Latência de Escrita

Embora as chaves estrangeiras garantam a integridade dos dados, elas introduzem sobrecarga durante operações de escrita. Ao inserir ou atualizar um registro, o banco de dados deve verificar se o registro referenciado existe. Esse processo de verificação leva tempo.

Em um sistema com integridade referencial rigorosa, cada restrição de chave estrangeira adiciona uma verificação. Se a tabela referenciada for grande, essa verificação pode se tornar um gargalo. Além disso, exclusões em cascata podem desencadear uma cadeia de exclusões em múltiplas tabelas, bloqueando recursos por períodos prolongados.

Considerações sobre Escrita versus Leitura

- Sistemas com Leitura Intensa:Pode tolerar uma integridade ligeiramente menor para joins mais rápidos.

- Sistemas com Escrita Intensa:Beneficiam-se da remoção de restrições ou do uso de validação em nível de aplicação.

- Exclusões em Cascata: Devem ser usadas com parcimônia para evitar tempestades de bloqueio.

Algumas arquiteturas optam por garantir a integridade na camada de aplicação, em vez da camada de banco de dados. Isso transfere a carga de latência para a aplicação, mas pode melhorar o throughput do banco de dados. No entanto, isso exige código de aplicação robusto para evitar corrupção de dados.

🔄 Táticas de Denormalização

Quando o ERM cria muitas etapas para consultas comuns, a denormalização torna-se uma solução viável. Isso envolve introduzir deliberadamente redundância no esquema para reduzir a necessidade de junções. Por exemplo, armazenar o nome de um cliente diretamente na tabela de pedidos evita uma junção com a tabela de clientes.

Essa técnica reduz significativamente a latência de leitura. Os dados são fisicamente localizados juntos, o que significa que podem ser lidos a partir de um único bloco de disco. No entanto, introduz complexidade na manutenção da consistência. Se um cliente mudar seu nome, todos os registros de pedidos que contêm esse nome devem ser atualizados.

Quando denormalizar

- Painéis de Relatórios:Armazéns de dados somente leitura frequentemente usam esquemas denormalizados.

- Negociação de Alta Frequência:Onde milissegundos importam mais do que a eficiência de armazenamento.

- Camadas de Cache:Pré-agregando dados em um armazenamento separado e denormalizado.

A decisão de denormalizar deve ser baseada em dados. Monitorar o desempenho das consultas e identificar gargalos fornece as evidências necessárias para justificar mudanças no esquema. Denormalizar cegamente pode levar a anomalias de dados e custos aumentados de manutenção.

✅ Lista de Verificação de Otimização

Para garantir que seu Modelo de Relacionamento de Entidades suporte operações de baixa latência, revise os seguintes pontos na fase de design:

- Mapeie os Padrões de Acesso:Compreenda como os usuários consultam os dados antes de definir as tabelas.

- Analise os Caminhos de Junção:Minimize o número de tabelas envolvidas em consultas críticas.

- Indexe Chaves Estrangeiras:Garanta que todas as colunas de relacionamento sejam indexadas.

- Revise a Cardinalidade:Evite relacionamentos muitos para muitos desnecessários.

- Monitore o Crescimento:Projete para o volume futuro de dados, e não apenas para as necessidades atuais.

- Teste Consultas:Execute consultas reais contra o esquema para medir o tempo de execução.

- Equilibre Restrições:Pese o custo das verificações de integridade contra as necessidades de desempenho.

Ao tratar o ERD como uma ferramenta de desempenho, e não apenas como um artefato de documentação, as equipes podem reduzir significativamente a latência. O modelo define a realidade física do armazenamento de dados, e alinhar esse modelo às necessidades da aplicação é a chave para um sistema responsivo.

🚀 Pensamentos Finais sobre o Desempenho do Esquema

A latência do banco de dados é uma questão multifacetada que não pode ser resolvida apenas com atualizações de hardware. O Modelo de Relacionamento de Entidades forma a base da acessibilidade dos dados. Cada linha desenhada em um diagrama representa uma possível rota para recuperação de dados. Otimizar essas rotas exige um profundo entendimento de como o motor do banco de dados processa relacionamentos.

Os designers devem navegar pela tensão entre normalização e desempenho. Embora estruturas normalizadas ofereçam clareza e integridade, podem introduzir latência por meio de junções. A desnormalização oferece velocidade, mas exige manutenção rigorosa. O equilíbrio certo depende da carga de trabalho específica e da criticalidade da consistência dos dados.

À medida que os sistemas crescem, o custo da ineficiência se acumula. Um esquema projetado para um conjunto de dados pequeno pode ter dificuldades sob carga pesada. A revisão contínua do modelo garante que o banco de dados continue a se desempenhar com eficiência à medida que os requisitos evoluem. Priorizar a estrutura dos dados é a maneira mais eficaz de controlar a latência a longo prazo.