Projetar estruturas de dados robustas exige um equilíbrio entre a pureza teórica e o desempenho prático. Ao trabalhar com modelos de relacionamento de entidades complexos (ERDs), aderir estritamente às regras de normalização frequentemente gera atritos em ambientes de alta velocidade. Este artigo explora táticas estratégicas de denormalização projetadas para aumentar a eficiência das consultas, mantendo ao mesmo tempo a integridade dos dados. Analisaremos quando desviar das formas padrão e como implementar redundância de forma segura.

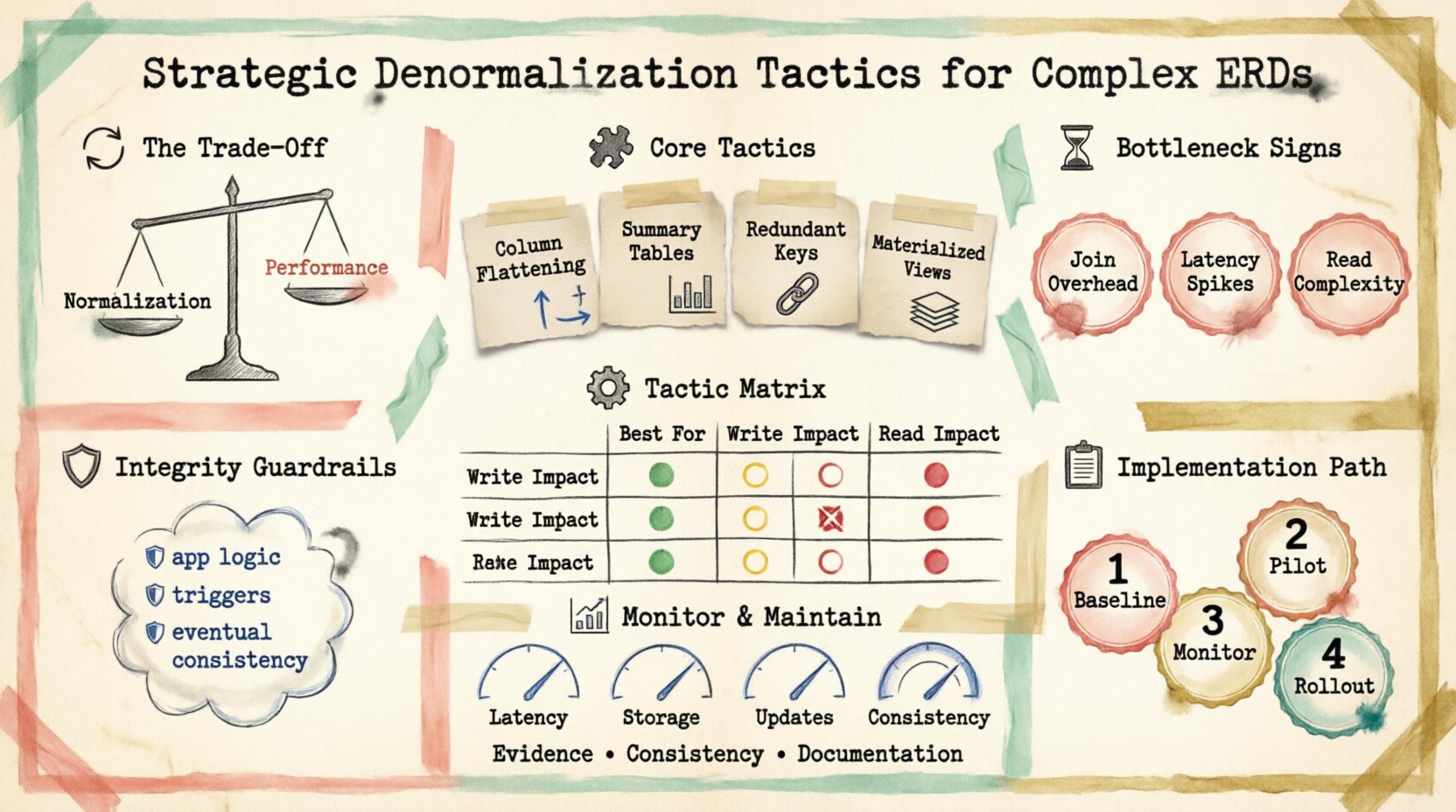

Arquitetos de bancos de dados frequentemente enfrentam uma escolha entre otimizar para operações de escrita ou leitura. A normalização reduz a redundância, garantindo a consistência dos dados. No entanto, pode aumentar o número de junções necessárias para recuperação, afetando a latência. A denormalização reintroduz redundância para simplificar os padrões de acesso. Essa abordagem não é sobre abandonar as melhores práticas, mas aplicá-las onde a lógica de negócios o exige.

O Custo da Normalização Estrita 🔄

Em um estado normalizado, os dados são organizados em tabelas distintas para minimizar a duplicação. Essa estrutura é ideal para eficiência de armazenamento e consistência na escrita. No entanto, à medida que o número de relacionamentos cresce, a complexidade para recuperar um único registro aumenta.

- Custo de Junção: Cada operação de junção consome recursos de CPU e memória. Consultas complexas em cinco ou mais tabelas podem se tornar gargalos.

- Latência: As viagens de rede aumentam com o número de tabelas envolvidas. Em sistemas distribuídos, essa latência é amplificada.

- Complexidade de Leitura: A lógica da aplicação torna-se mais complexa, pois deve coordenar múltiplos passos de recuperação de dados.

Para painéis de relatórios, análises em tempo real ou interfaces voltadas para o usuário, onde a velocidade de leitura é crítica, o custo da normalização pode superar seus benefícios. Compreender essa troca é o primeiro passo na otimização estratégica.

Identificando Gargalos de Desempenho ⏱️

Antes de alterar o esquema, você deve identificar pontos de dor específicos. Nem toda consulta lenta exige denormalização. Use ferramentas de perfil para analisar planos de execução.

- Alto Tempo de Espera de I/O: Indica leitura excessiva do disco, frequentemente causada por varreduras em tabelas grandes.

- Contenção de Bloqueios: Bloqueios frequentes durante leituras podem indicar estruturas de dados excessivamente fragmentadas.

- Consultas de Agregação Lentas: Cálculos em múltiplas tabelas frequentemente sofrem com o custo da normalização.

Quando essas métricas aparecem consistentemente, sinalizam uma oportunidade para reestruturar os dados. O objetivo é reduzir a carga computacional sobre o motor sem comprometer a fonte da verdade.

Abordagens Táticas Principais 🧩

Existem vários métodos para introduzir redundância de forma estratégica. A escolha depende da razão entre leitura e escrita da sua carga de trabalho específica.

1. Achatamento de Colunas

Isso envolve mover dados de tabelas relacionadas diretamente para a tabela principal. Por exemplo, armazenar o endereço de e-mail de um usuário na tabela de pedidos, em vez de fazer uma junção com a tabela de usuários toda vez que um pedido for recuperado.

- Benefício: Elimina a necessidade de junção para detalhes do usuário.

- Restrição: Os dados devem ser atualizados sempre que o perfil do usuário mudar.

2. Tabelas de Resumo

Agregados pré-calculados podem coexistir com dados transacionais detalhados. Isso é comum em relatórios financeiros ou gestão de estoque.

- Benefício: Acesso instantâneo a totais, médias e contagens.

- Restrição: Exige um mecanismo para manter os agregados em sincronia com os dados brutos.

3. Chaves estrangeiras redundantes

Freqüentemente, uma chave de pai é necessária em uma tabela filha para pesquisas rápidas. Adicionar uma chave estrangeira redundante permite referência direta sem percorrer a hierarquia.

- Benefício: Percursos mais rápidos em hierarquias profundas.

- Restrição: Aumenta levemente o armazenamento e exige verificações de consistência.

Matriz de Comparação de Táticas

| Tática | Melhor para | Impacto na escrita | Impacto na leitura |

|---|---|---|---|

| Achatamento de colunas | Consultas com muitas pesquisas | Médio | Baixo |

| Tabelas de resumo | Relatórios e análise | Alto | Muito baixo |

| Chaves redundantes | Hierarquias profundas | Baixo | Baixo |

| Visualizações materializadas | Junções complexas | Médio | Baixo |

Gerenciando a Integridade dos Dados 🛡️

Introduzir redundância cria um risco de divergência de dados. Se os dados de origem mudarem e a cópia redundante não, o sistema torna-se confiável. Esse é o principal desafio da desnormalização.

- Lógica no Nível do Aplicativo: Certifique-se de que o código atualize todas as cópias dos dados em uma única transação.

- Gatilhos:Gatilhos do banco de dados podem automatizar as atualizações em campos redundantes quando as tabelas de origem forem alteradas.

- Consistência Eventual:Em alguns sistemas, pequenos atrasos entre as atualizações são aceitáveis. Isso reduz a carga, mas exige que o aplicativo trate os dados desatualizados de forma adequada.

Regras de validação são essenciais. Auditorias periódicas devem comparar os dados de origem com as cópias redundantes para detectar desvios. Se uma discrepância for encontrada, um script de reconciliação deve ser executado para restaurar a consistência.

Estratégia de Implementação 📋

Não refatore todo o banco de dados de uma vez. Adote uma abordagem faseada para minimizar o risco.

- Medição de Referência:Registre os tempos atuais de consulta e o uso de recursos.

- Desnormalização de Piloto:Selecione uma consulta de alto impacto e otimize-a.

- Monitoramento:Monitore melhorias de desempenho e erros de consistência de dados.

- Implantação:Expanda o padrão para outras áreas de alto volume.

A documentação é crítica. Marque claramente quais tabelas estão desnormalizadas e por quê. Desenvolvedores futuros precisam entender as decisões de compromisso feitas no design do esquema.

Monitoramento de Métricas de Desempenho 📊

Uma vez que a desnormalização esteja ativa, o monitoramento contínuo garante que a estratégia permaneça eficaz.

- Latência de Consulta:Monitore aumentos que possam indicar contenção de bloqueios em tabelas atualizadas.

- Crescimento de Armazenamento:Dados redundantes consomem mais espaço. Planeje a capacidade adequadamente.

- Frequência de Atualização:Volumes elevados de escrita em tabelas desnormalizadas podem degradar o desempenho.

- Erros de consistência:Registre quaisquer falhas no processo de sincronização.

Alertas devem ser configurados para anomalias. Se uma tabela específica crescer mais rápido do que o esperado, isso pode indicar um erro lógico na forma como os dados estão sendo replicados.

Protocolos de manutenção 🔧

Manter um esquema desnormalizado exige disciplina. Não é uma configuração de ‘defina e esqueça’.

- Versionamento de esquema:Trate as alterações de esquema como código. Revise os scripts de migração regularmente.

- Rotinas de limpeza:Remova dados redundantes que já não são necessários para economizar espaço.

- Frequência de revisão:Reavalie a necessidade de desnormalização conforme os requisitos de negócios mudam.

Às vezes, a otimização inicial já não é mais necessária se o volume de dados diminuir ou os padrões de acesso mudarem. Revisões regulares impedem que a dívida técnica se acumule.

Frequência estratégica de revisão 🔄

O design de banco de dados não é estático. O que funciona hoje pode não funcionar amanhã. Agende revisões trimestrais do Modelo de Relacionamento de Entidades.

- Análise de carga de trabalho:A proporção de leituras para gravações mudou?

- Atualizações de hardware:Nova tecnologia de armazenamento pode mudar o custo das junções.

- Objetivos de negócios:Novas funcionalidades podem exigir estruturas de dados diferentes.

A flexibilidade é essencial. Esteja preparado para re-normalizar se o custo de manter a redundância ultrapassar os ganhos de desempenho. O objetivo é sempre um comportamento ótimo do sistema, e não a aderência a um dogma de design específico.

Pensamentos finais sobre a evolução de esquema 📝

A desnormalização é uma ferramenta poderosa na cesta de ferramentas do arquiteto de banco de dados. Ela resolve problemas reais de desempenho que os modelos teóricos às vezes ignoram. Ao aplicar essas estratégias de forma metódica, você pode construir sistemas que são rápidos e confiáveis ao mesmo tempo.

- Foque em evidências:Baseie decisões em métricas, não em suposições.

- Priorize a consistência:Garanta que os dados permaneçam precisos em todas as camadas.

- Documente decisões:Mantenha um registro sobre por que tabelas específicas foram modificadas.

Com planejamento cuidadoso e manutenção contínua, modelos de relacionamento de entidades complexos podem entregar o desempenho exigido por aplicações modernas. O caminho para a eficiência é iterativo, exigindo atenção constante ao equilíbrio entre estrutura e velocidade.