L’architecture de votre système de stockage de données est souvent invisible pour l’utilisateur final, mais elle détermine la réactivité de chaque interaction. Lorsqu’un utilisateur clique sur un bouton, le parcours depuis cette action jusqu’à la rétroaction visuelle dépend largement de la rapidité avec laquelle le moteur de base de données sous-jacent peut récupérer et traiter les informations. Cette vitesse, appelée latence, n’est pas simplement une fonction de la capacité matérielle ou de la bande passante du réseau. Elle est fondamentalement ancrée dans la conception de la structure des données elle-même.

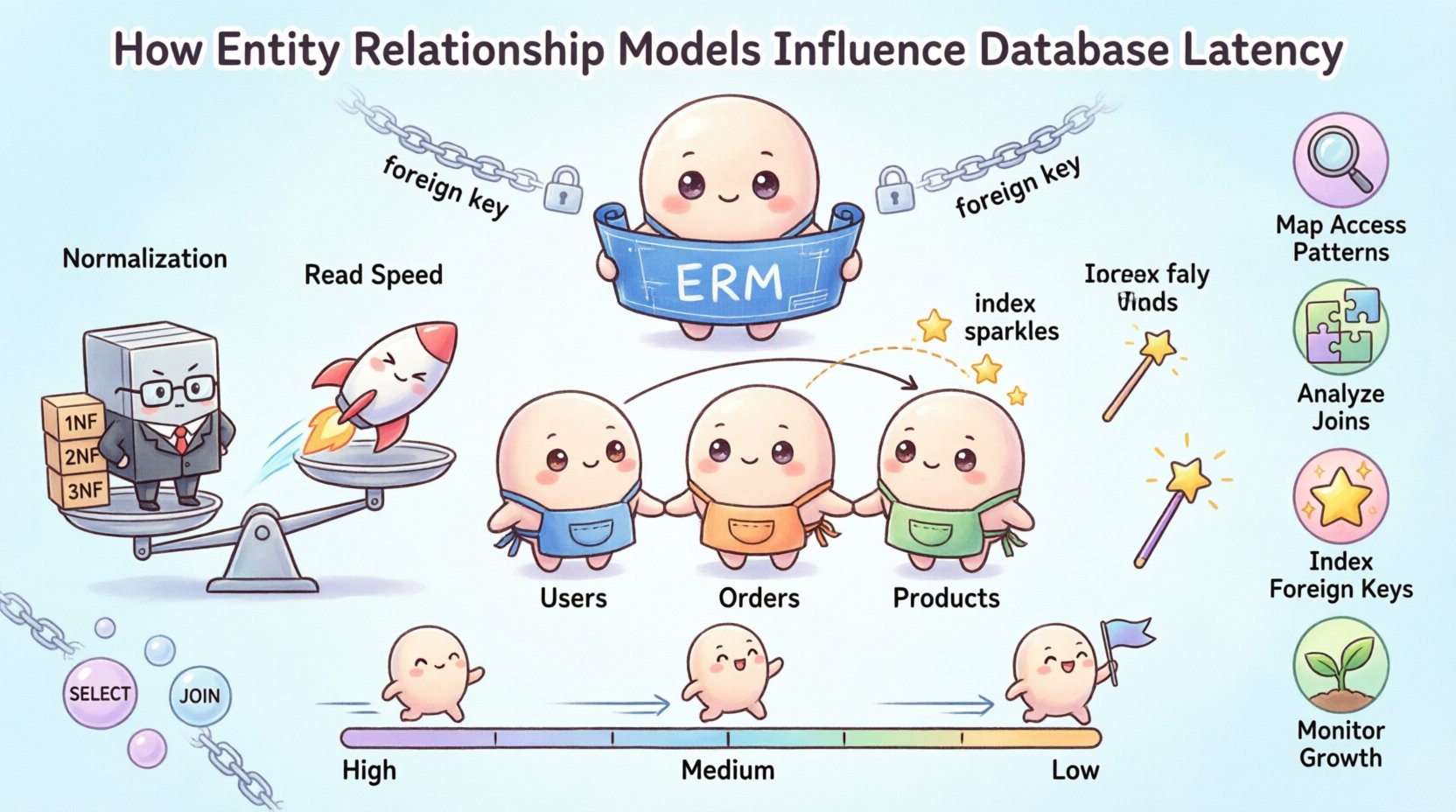

Le modèle entité-association (MEA) sert de plan directeur pour cette structure. Il définit comment les entités sont stockées, comment elles sont liées les unes aux autres, et comment les contraintes rassemblent les données. Un modèle mal conçu peut introduire des frottements inutiles, poussant les requêtes à traverser plus de blocs disque qu’il ne serait nécessaire, ou forçant le processeur à effectuer des jointures complexes qui ralentissent le système. À l’inverse, un modèle bien optimisé anticipe les schémas d’accès et aligne les structures de stockage sur les exigences des requêtes.

🏗️ La relation fondamentale entre le schéma et la vitesse

La latence dans un environnement de base de données est généralement mesurée en millisecondes ou en microsecondes. Bien qu’une seule milliseconde puisse sembler négligeable, dans les systèmes à haut débit, ces délais s’accumulent rapidement. Le diagramme entité-association (DEA) agit comme un plan logique pour le stockage physique. Chaque ligne reliant deux entités représente une opération de jointure potentielle. Chaque attribut au sein d’une entité représente une colonne qui doit être analysée ou indexée.

Lorsque les développeurs conçoivent un MEA, ils prennent des décisions qui ont un impact direct sur le plan d’exécution choisi par le moteur de base de données. Le moteur s’appuie sur les métadonnées dérivées de ce modèle pour déterminer le chemin le plus efficace vers les données. Si le modèle suggère une structure fortement normalisée, le moteur peut devoir effectuer plusieurs recherches pour reconstruire un enregistrement complet. Cela augmente le nombre d’opérations d’E/S nécessaires.

- Conception logique : Définit clairement les relations et les contraintes.

- Implémentation physique : Traduit la conception logique en structures de stockage réelles.

- Exécution des requêtes : Dépend des métadonnées fournies par le schéma.

Comprendre cette chaîne est crucial. Un changement dans le modèle logique peut se propager au niveau physique, modifiant la manière dont les données sont mises en cache, comment les index sont construits et comment les transactions sont verrouillées. L’objectif est de trouver un équilibre entre l’intégrité des données et l’efficacité de la récupération.

📉 Compromis entre normalisation et latence

La normalisation est le processus d’organisation des données afin de réduire la redondance. Bien qu’elle assure la cohérence, elle se fait souvent au détriment des performances de lecture. Les formes standards de normalisation (1FN, 2FN, 3FN) poussent les données vers des tables plus petites et plus spécifiques. Pour obtenir une vue complète d’une entité, le système doit joindre ensemble ces tables.

Prenons un scénario où les détails des commandes clients sont stockés dans des tables distinctes. Récupérer l’historique complet d’une commande nécessite de joindre les tables Clients, Commandes, et Articles de commande tables. Chaque jointure introduit une surcharge CPU et des opérations d’E/S disque. Si le moteur de base de données ne peut pas utiliser efficacement un index, il peut être contraint d’effectuer un balayage complet de la table, augmentant considérablement la latence.

Principaux impacts de la normalisation

- Réduction de la redondance : Moins d’espace de stockage requis pour les valeurs répétées.

- Cohérence : Les mises à jour ont lieu à un seul endroit, réduisant les anomalies.

- Augmentation des jointures : Les requêtes complexes nécessitent plus de ressources de calcul.

- Fragmentation : Les données sont réparties sur plusieurs pages, ce qui peut augmenter le temps de recherche.

Pour les applications à forte charge d’écriture, la normalisation est souvent bénéfique. Elle réduit la quantité de données écrites par transaction. Toutefois, pour les charges de lecture importantes, le coût de reconstruction des données peut devenir un goulot d’étranglement. Le choix entre normaliser ou dénormaliser dépend entièrement des modèles d’accès spécifiques de l’application.

🔗 Complexité des jointures et plans d’exécution

La complexité des relations définies dans le MCD influence directement la complexité des jointures. Un moteur de base de données analyse le graphe des tables et des relations pour déterminer l’ordre dans lequel traiter les jointures. Dans un schéma plat, cela est trivial. Dans un schéma hautement relationnel, le moteur doit calculer l’ordre de jointure le plus efficace.

Lorsque le modèle inclut des relations plusieurs à plusieurs, le système introduit généralement une table de liaison. Cela ajoute une couche supplémentaire d’indirection. Chaque fois que vous interrogez ces relations, le moteur doit résoudre le lien. Si les clés étrangères définissant ces liens ne sont pas indexées, la recherche devient une recherche linéaire, ce qui est coûteux en termes de calcul.

Types de jointures et performance

| Type de jointure | Impact sur la latence | Cas d’utilisation |

|---|---|---|

| Jointure interne | Faible à moyenne | Récupération uniquement des enregistrements correspondants. |

| Jointure gauche/droite | Moyen | Récupération de tous les enregistrements d’un côté, correspondance de l’autre. |

| Jointure croisée | Élevé | Produits cartésiens ; rarement utilisés en production. |

| Jointure auto | Élevé | Jointure d’une table à elle-même pour des données hiérarchiques. |

Minimiser l’utilisation des jointures complexes est une stratégie principale pour réduire la latence. Cela implique souvent de repenser le MCD afin de platifier les données là où cela est approprié. Toutefois, cela doit être fait sans compromettre l’intégrité logique du modèle de données.

📎 Stratégies d’indexation basées sur le MCD

Le MCD détermine où placer les index. Les clés étrangères sont les candidats les plus courants pour l’indexation. Lorsqu’une table référence une autre, la colonne de relation devient un chemin de recherche critique. Sans index sur cette clé étrangère, chaque mise à jour de la table parente nécessite un balayage de la table enfant pour vérifier les violations de contraintes.

En outre, la cardinalité de la relation influence la stratégie d’indexation. Une relation un à plusieurs suggère que l’index du côté plusieurs (l’enfant) comportera de nombreuses valeurs en double. Une relation plusieurs à plusieurs implique une table de jonction qui nécessite des index composés pour fonctionner efficacement.

- Clés primaires : Toujours indexées pour une identification rapide des lignes.

- Clés étrangères : Critiques pour la performance des jointures et l’application des contraintes.

- Clés composées : Utile pour les requêtes filtrant sur plusieurs colonnes.

- Index couvrants : Inclure toutes les données nécessaires à une requête pour éviter les recherches dans les tables.

Un sur-indexage est également un risque. Chaque index consomme de l’espace de stockage et ralentit les opérations d’écriture, car la base de données doit mettre à jour la structure de l’index en même temps que les données. Le schéma ER aide à identifier les relations fréquemment interrogées, ce qui guide le placement de ces index.

⚙️ Contraintes de clés étrangères et latence d’écriture

Bien que les clés étrangères garantissent l’intégrité des données, elles introduisent une surcharge lors des opérations d’écriture. Lorsqu’on insère ou met à jour un enregistrement, la base de données doit vérifier que l’enregistrement référencé existe. Ce processus de vérification prend du temps.

Dans un système avec intégrité référentielle stricte, chaque contrainte de clé étrangère ajoute une vérification. Si la table référencée est grande, cette vérification peut devenir un goulot d’étranglement. En outre, les suppressions en cascade peuvent déclencher une chaîne de suppressions à travers plusieurs tables, verrouillant les ressources pendant de longues périodes.

Considérations sur l’écriture versus la lecture

- Systèmes à lecture dominante : Peuvent tolérer une intégrité légèrement réduite pour des jointures plus rapides.

- Systèmes à écriture dominante : Bénéficient de la suppression des contraintes ou de la validation au niveau de l’application.

- Suppressions en cascade : Doivent être utilisées avec parcimonie pour éviter les tempêtes de verrouillage.

Certaines architectures choisissent de garantir l’intégrité au niveau de la couche application plutôt qu’au niveau de la base de données. Cela déplace la charge de latence vers l’application, mais peut améliorer le débit de la base de données. Toutefois, cela nécessite un code d’application robuste pour éviter la corruption des données.

🔄 Stratégies de dénormalisation

Lorsque le modèle ERM crée trop de sauts pour les requêtes courantes, la dénormalisation devient une solution viable. Cela consiste à introduire délibérément de la redondance dans le schéma afin de réduire le besoin de jointures. Par exemple, stocker le nom d’un client directement dans la table des commandes évite une jointure avec la table des clients.

Cette technique réduit considérablement la latence de lecture. Les données sont physiquement regroupées, ce qui signifie qu’elles peuvent être lues à partir d’un seul bloc disque. Toutefois, elle introduit une complexité dans le maintien de la cohérence. Si un client change de nom, chaque enregistrement de commande contenant ce nom doit être mis à jour.

Quand dénormaliser

- Tableaux de bord de reporting :Les entrepôts de données en lecture seule utilisent souvent des schémas dénormalisés.

- Trading à haute fréquence : Où les millisecondes comptent plus que l’efficacité du stockage.

- Niveaux de mise en cache : Pré-agrégation des données dans un magasin séparé et dénormalisé.

La décision de dénormaliser doit être guidée par les données. Le suivi des performances des requêtes et l’identification des goulets d’étranglement fournissent les preuves nécessaires pour justifier les modifications du schéma. Dénormaliser aveuglément peut entraîner des anomalies de données et des coûts de maintenance accrus.

✅ Liste de contrôle d’optimisation

Pour garantir que votre modèle d’entités et de relations supporte des opérations à faible latence, passez en revue les points suivants pendant la phase de conception :

- Cartographier les modèles d’accès : Comprendre comment les utilisateurs interrogent les données avant de définir les tables.

- Analyser les chemins de jointure : Minimiser le nombre de tables impliquées dans les requêtes critiques.

- Indexer les clés étrangères : Assurez-vous que toutes les colonnes de relation sont indexées.

- Revoir la cardinalité : Évitez les relations plusieurs à plusieurs inutiles.

- Surveiller la croissance : Concevez pour le volume futur de données, et non seulement pour les besoins actuels.

- Tester les requêtes : Exécutez des requêtes réelles contre le schéma pour mesurer le temps d’exécution.

- Équilibrer les contraintes : Pesez le coût des vérifications d’intégrité par rapport aux besoins de performance.

En traitant le MCD comme un outil de performance plutôt que comme un simple document, les équipes peuvent réduire significativement la latence. Le modèle dicte la réalité physique du stockage des données, et aligner ce modèle sur les besoins de l’application est la clé d’un système réactif.

🚀 Réflexions finales sur les performances du schéma

La latence de la base de données est un problème multifacette qui ne peut être résolu par des mises à niveau matérielles seules. Le modèle Entité-Relation forme la base de l’accessibilité des données. Chaque ligne tracée dans un diagramme représente un chemin potentiel pour la récupération des données. Optimiser ces chemins exige une compréhension approfondie de la manière dont le moteur de base de données traite les relations.

Les concepteurs doivent naviguer entre la normalisation et les performances. Bien que les structures normalisées offrent clarté et intégrité, elles peuvent introduire une latence par le biais des jointures. La dénormalisation offre une vitesse mais exige une maintenance rigoureuse. Le bon équilibre dépend de la charge de travail spécifique et de la criticité de la cohérence des données.

À mesure que les systèmes grandissent, le coût de l’inefficacité s’accumule. Un schéma conçu pour un petit jeu de données peut peiner sous une charge lourde. Un examen continu du modèle garantit que la base de données continue de fonctionner efficacement au fur et à mesure que les exigences évoluent. Prioriser la structure des données est le moyen le plus efficace de contrôler la latence à long terme.