Concevoir des structures de données robustes exige un équilibre entre la pureté théorique et les performances pratiques. Lorsqu’on travaille avec des modèles complexes de relations entre entités (ERD), s’attacher strictement aux règles de normalisation crée souvent des frictions dans des environnements à haute vitesse. Cet article explore des tactiques de dénormalisation stratégiques conçues pour améliorer l’efficacité des requêtes tout en maintenant l’intégrité des données. Nous examinerons quand déroger aux formes standards et comment implémenter en toute sécurité la redondance.

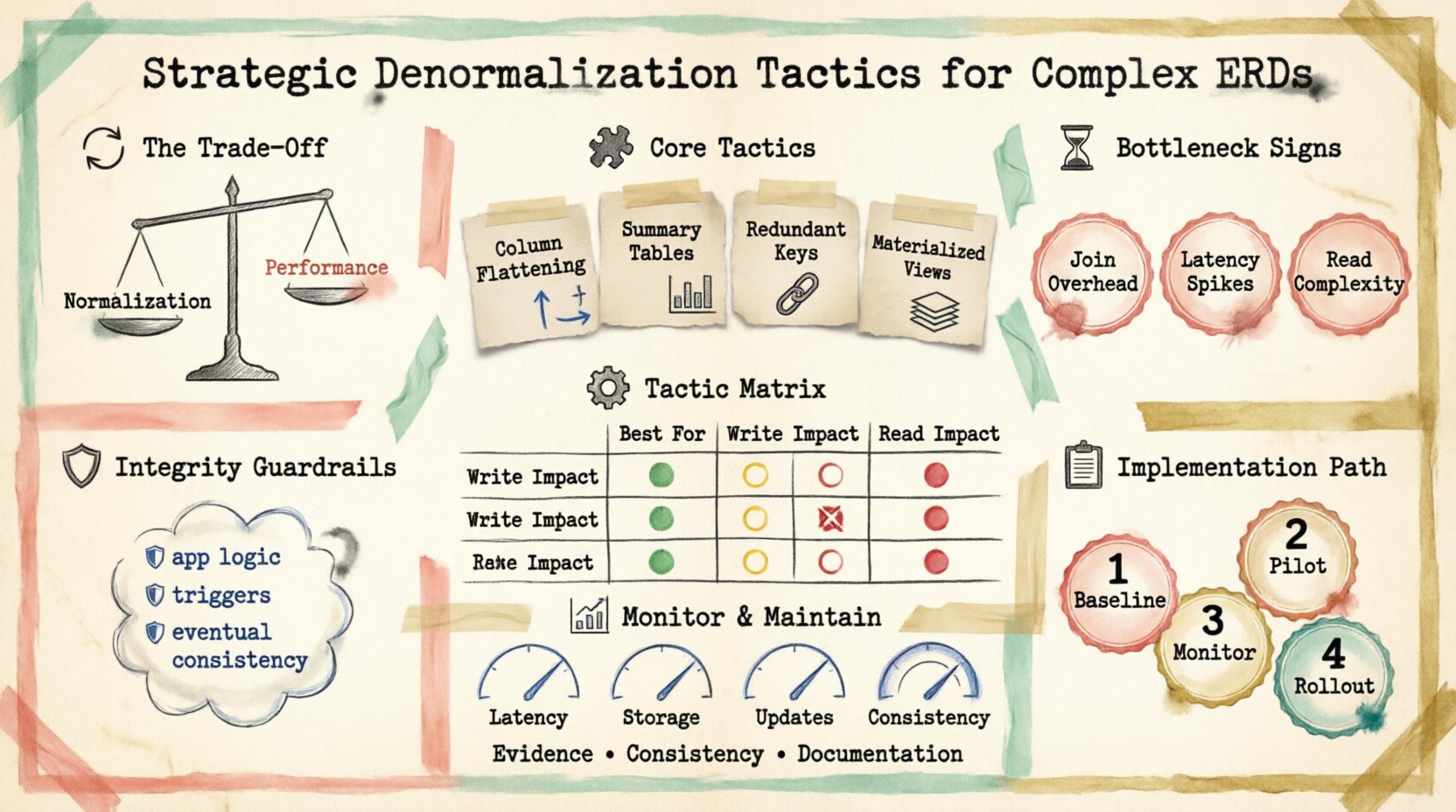

Les architectes de bases de données doivent souvent choisir entre optimiser les opérations d’écriture ou celles de lecture. La normalisation réduit la redondance, garantissant la cohérence des données. Toutefois, elle peut augmenter le nombre de jointures nécessaires à la récupération, ce qui impacte la latence. La dénormalisation réintroduit la redondance afin de simplifier les schémas d’accès. Cette approche ne consiste pas à abandonner les bonnes pratiques, mais à les appliquer là où la logique métier le demande.

Le coût de la normalisation stricte 🔄

Dans un état normalisé, les données sont organisées en tables distinctes afin de minimiser la duplication. Cette structure est idéale pour l’efficacité du stockage et la cohérence des écritures. Toutefois, à mesure que le nombre de relations augmente, la complexité de la récupération d’un enregistrement unique croît.

- Surcharge des jointures : Chaque opération de jointure consomme des ressources CPU et mémoire. Les requêtes complexes sur cinq tables ou plus peuvent devenir des goulets d’étranglement.

- Latence : Les allers-retours réseau augmentent avec le nombre de tables impliquées. Dans les systèmes distribués, cette latence est amplifiée.

- Complexité de lecture : La logique d’application devient plus complexe car elle doit orchestrer plusieurs étapes de récupération des données.

Pour les tableaux de bord de reporting, les analyses en temps réel ou les interfaces utilisateur où la vitesse de lecture est critique, le coût de la normalisation peut dépasser ses avantages. Comprendre ce compromis est la première étape de l’optimisation stratégique.

Identifier les goulets d’étranglement des performances ⏱️

Avant de modifier le schéma, vous devez identifier les points de douleur spécifiques. Toute requête lente n’exige pas nécessairement une dénormalisation. Utilisez des outils de profilage pour analyser les plans d’exécution.

- Attente élevée d’E/S : Indique une lecture disque excessive, souvent causée par le balayage de grandes tables.

- Contestation de verrouillage : Les verrous fréquents lors des lectures peuvent indiquer des structures de données trop fragmentées.

- Requêtes agrégées lentes : Les calculs sur plusieurs tables souffrent souvent du surcroît lié à la normalisation.

Lorsque ces métriques apparaissent de manière constante, cela signale une opportunité de restructurer les données. L’objectif est de réduire la charge computationnelle sur le moteur sans compromettre la source de vérité.

Approches tactiques fondamentales 🧩

Il existe plusieurs méthodes pour introduire de la redondance de manière stratégique. Le choix dépend du rapport lecture/écriture de votre charge de travail spécifique.

1. Aplatissage de colonnes

Cela consiste à déplacer des données depuis des tables liées directement dans la table principale. Par exemple, stocker l’adresse e-mail d’un utilisateur dans une table de commande, plutôt que de joindre la table utilisateur chaque fois qu’une commande est récupérée.

- Avantage : Élimine la nécessité de jointure pour les détails de l’utilisateur.

- Contrainte : Les données doivent être mises à jour chaque fois que le profil utilisateur change.

2. Tables de synthèse

Les agrégats précalculés peuvent coexister avec les données transactionnelles détaillées. Cela est courant dans les rapports financiers ou la gestion des stocks.

- Avantage :Accès instantané aux totaux, aux moyennes et aux comptages.

- Contrainte :Nécessite un mécanisme pour maintenir les agrégats synchronisés avec les données brutes.

3. Clés étrangères redondantes

Souvent, une clé parente est nécessaire dans une table enfant pour des recherches rapides. L’ajout d’une clé étrangère redondante permet une référence directe sans parcourir l’héritage.

- Avantage :Parcours plus rapide dans les hiérarchies profondes.

- Contrainte : Augmente légèrement le stockage et nécessite des vérifications de cohérence.

Matrice de comparaison des tactiques

| Tactique | Meilleur usage | Impact sur l’écriture | Impact sur la lecture |

|---|---|---|---|

| Platissage de colonnes | Requêtes à forte charge de recherche | Moyen | Faible |

| Tables de synthèse | Rapports et analyse | Élevé | Très faible |

| Clés redondantes | Hiérarchies profondes | Faible | Faible |

| Vues matérialisées | Jointures complexes | Moyen | Faible |

Gestion de l’intégrité des données 🛡️

L’introduction de redondance crée un risque de divergence des données. Si les données sources changent et que la copie redondante ne change pas, le système devient peu fiable. C’est le principal défi de la dénormalisation.

- Logique au niveau de l’application : Assurez-vous que le code met à jour toutes les copies des données au sein d’une seule transaction.

- Déclencheurs :Les déclencheurs de base de données peuvent automatiser les mises à jour des champs redondants lorsque les tables sources changent.

- Consistance éventuelle :Dans certains systèmes, de légères délais entre les mises à jour sont acceptables. Cela réduit la charge, mais nécessite que l’application gère les données obsolètes de manière appropriée.

Les règles de validation sont essentielles. Des audits périodiques doivent comparer les données sources aux copies redondantes pour détecter les écarts. Si une incohérence est détectée, un script de reconciliation doit être exécuté pour restaurer la cohérence.

Stratégie d’implémentation 📋

Ne refactorisez pas toute la base de données d’un coup. Adoptez une approche progressive pour minimiser les risques.

- Mesure de référence :Enregistrez les temps de requête actuels et l’utilisation des ressources.

- Pilotage de la dénormalisation :Sélectionnez une requête à fort impact et optimisez-la.

- Surveillance :Suivez les améliorations de performance et les erreurs d’intégrité des données.

- Déploiement :Étendez ce modèle à d’autres zones à fort volume.

La documentation est essentielle. Marquez clairement les tables qui sont dénormalisées et pourquoi. Les développeurs futurs doivent comprendre les compromis effectués dans la conception du schéma.

Surveillance des métriques de performance 📊

Une fois la dénormalisation active, une surveillance continue garantit que la stratégie reste efficace.

- Latence des requêtes :Surveillez les augmentations qui pourraient indiquer une contention de verrou sur les tables mises à jour.

- Croissance du stockage :Les données redondantes consomment plus d’espace. Prévoyez la capacité en conséquence.

- Fréquence des mises à jour :Les volumes élevés d’écriture sur les tables dénormalisées peuvent dégrader les performances.

- Erreurs de cohérence :Enregistrez toutes les erreurs survenues au cours du processus de synchronisation.

Des alertes doivent être configurées pour les anomalies. Si une table spécifique croît plus vite que prévu, cela peut indiquer une erreur logique dans la manière dont les données sont répliquées.

Protocoles de maintenance 🔧

Maintenir un schéma dénormalisé exige de la discipline. Ce n’est pas une configuration une fois pour toutes.

- Gestion des versions du schéma :Traitez les modifications de schéma comme du code. Revoyez régulièrement les scripts de migration.

- Routines de nettoyage :Supprimez les données redondantes qui ne sont plus nécessaires pour économiser de l’espace.

- Fréquence des revues :Réévaluez le besoin de dénormalisation au fur et à mesure que les exigences métiers évoluent.

Parfois, l’optimisation initiale n’est plus nécessaire si le volume de données diminue ou si les modèles d’accès changent. Des revues régulières empêchent l’accumulation de la dette technique.

Fréquence stratégique des revues 🔄

La conception de base de données n’est pas statique. Ce qui fonctionne aujourd’hui peut ne plus fonctionner demain. Prévoyez des revues trimestrielles du modèle Entité-Relation.

- Analyse de charge :Le ratio des lectures par rapport aux écritures a-t-il changé ?

- Mises à jour du matériel :De nouvelles technologies de stockage pourraient modifier le coût des jointures.

- Objectifs métiers :De nouvelles fonctionnalités pourraient nécessiter des structures de données différentes.

La flexibilité est essentielle. Soyez prêt à rénormaliser si le coût de maintien de la redondance dépasse les gains de performance. L’objectif est toujours un comportement optimal du système, et non une adhésion aveugle à un dogme de conception spécifique.

Réflexions finales sur l’évolution du schéma 📝

La dénormalisation est un outil puissant dans le kit de l’architecte de base de données. Elle résout des problèmes de performance du monde réel que les modèles théoriques négligent parfois. En appliquant ces tactiques de manière méthodique, vous pouvez construire des systèmes à la fois rapides et fiables.

- Concentrez-vous sur les preuves :Fondez vos décisions sur des métriques, et non sur des hypothèses.

- Priorisez la cohérence :Assurez que les données restent précises à travers toutes les couches.

- Documentez les décisions :Gardez une trace de la raison pour laquelle des tables spécifiques ont été modifiées.

Avec une planification soigneuse et un entretien continu, des modèles d’entités-relations complexes peuvent offrir les performances requises par les applications modernes. Le chemin vers l’efficacité est itératif, exigeant une attention constante au bon équilibre entre structure et vitesse.