L’architecture des données forme le socle de tout système numérique solide. Lorsqu’une application évolue, la structure sous-jacente doit évoluer pour gérer une charge, une complexité et un volume accrus. Un diagramme d’entité relationnelle (ERD) est bien plus qu’une carte statique ; il s’agit d’un plan stratégique qui détermine la manière dont les informations circulent, s’interconnectent et persistent au sein d’une base de données. Concevoir pour la croissance exige une vision d’ensemble, en s’assurant que le schéma peut intégrer les besoins futurs sans nécessiter une reconstruction complète.

Un modèle mal conçu entraîne des goulets d’étranglement, des performances lentes des requêtes et des contraintes rigides qui freinent la vitesse de développement. À l’inverse, un ERD bien conçu favorise la flexibilité, l’intégrité et l’efficacité. Ce guide explore les principes essentiels de la construction de modèles de données capables de résister au fil du temps et à l’expansion.

Fondations de la modélisation des entités 🏗️

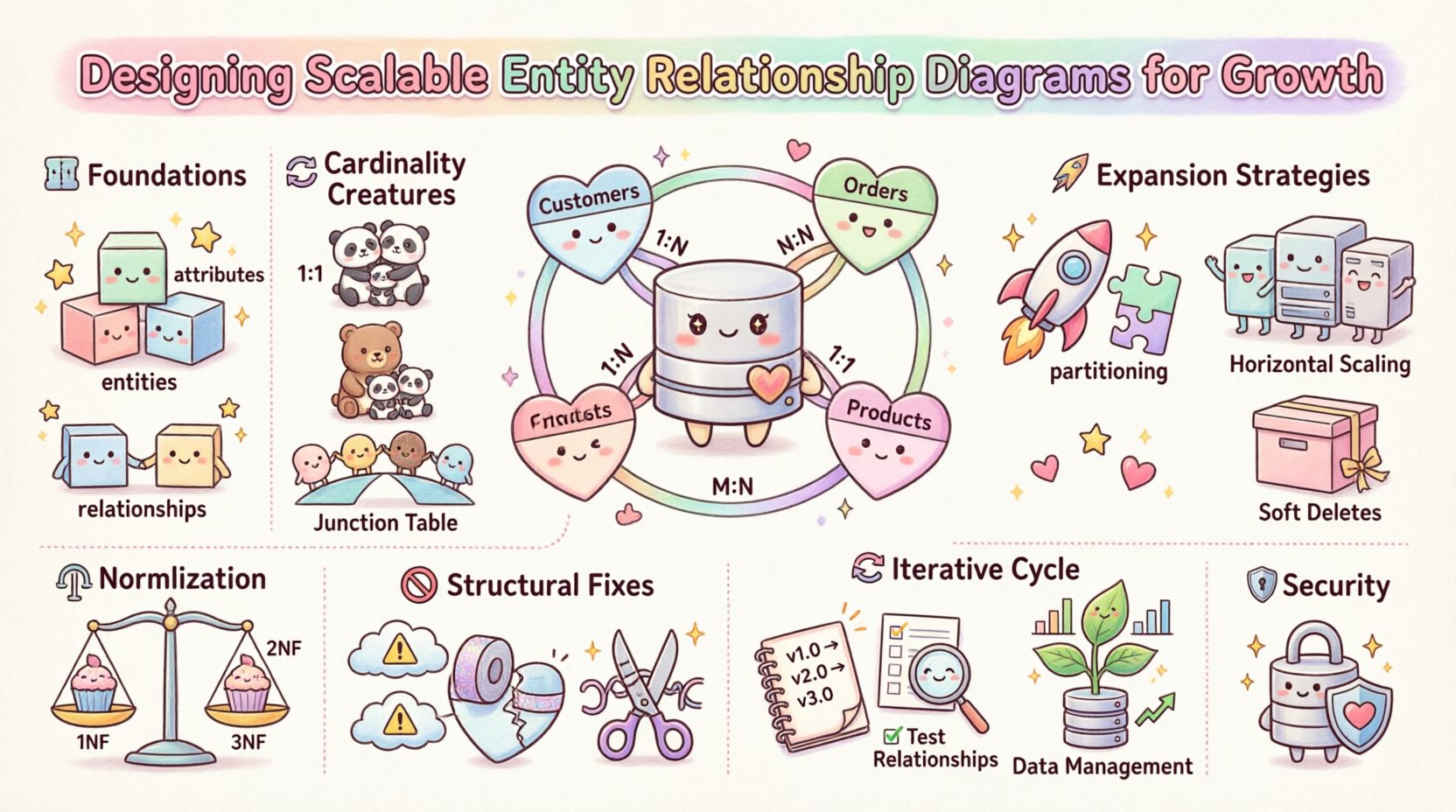

Avant d’aborder la scalabilité, il faut comprendre les composants fondamentaux. Un diagramme d’entité relationnelle visualise la structure des données à travers trois éléments principaux : les entités, les attributs et les relations.

-

Entités : Elles représentent des objets ou des concepts au sein du système, tels qu’un Utilisateur, Produit, ou Commande. Dans une base de données physique, les entités se traduisent par des tables.

-

Attributs : Ce sont les propriétés spécifiques décrivant une entité, telles qu’un nom d’utilisateur, prix, ou date_creation. Les attributs déterminent le niveau de granularité du stockage des données.

-

Relations : Elles définissent la manière dont les entités interagissent. Une relation établit la logique reliant une entité à une autre, souvent à travers des clés étrangères.

La clarté dans ces définitions évite toute ambiguïté pendant le développement. Chaque champ doit avoir un objectif précis, et chaque relation doit servir une règle métier logique. L’ambiguïté à l’étape de conception entraîne souvent des refacturations coûteuses ultérieurement.

Cardinalité et multiplicité 🔄

Comprendre la cardinalité des relations est essentiel pour la scalabilité. La cardinalité définit le nombre d’instances d’une entité qui peuvent ou doivent être associées à chaque instance d’une autre entité. Une mauvaise interprétation entraîne un stockage inefficace et des requêtes complexes.

-

Un à un (1:1) : Un enregistrement dans la table A est lié à exactement un enregistrement dans la table B. Cela est rare dans les systèmes à fort trafic, mais utile pour séparer les données sensibles ou les attributs facultatifs afin de réduire la largeur de la table.

-

Un à plusieurs (1:N) : Un seul enregistrement dans la table A est lié à plusieurs enregistrements dans la table B. C’est la relation la plus courante, telle qu’un Client ayant beaucoup Commandes.

-

Many-to-Many (M:N) : Les enregistrements de la table A sont liés à plusieurs enregistrements de la table B, et inversement. Cela nécessite une table de jonction pour résoudre en deux relations un-à-plusieurs afin de permettre leur implémentation.

À mesure que le volume de données augmente, les relations Many-to-Many peuvent devenir des goulets d’étranglement en performance. La table de jonction doit être indexée avec soin pour garantir que les recherches n’entraînent pas de ralentissement du système. Les concepteurs doivent évaluer si une relation Many-to-Many peut être simplifiée en une structure One-to-Many en introduisant un concept intermédiaire.

Stratégies de normalisation pour les performances ⚖️

La normalisation est le processus d’organisation des données afin de réduire la redondance et d’améliorer l’intégrité. Bien qu’elle soit souvent perçue comme une règle statique, le niveau de normalisation choisi influence directement la scalabilité.

-

Première forme normale (1NF) : Assure des valeurs atomiques. Chaque colonne ne contient qu’une seule valeur, éliminant ainsi les groupes répétés.

-

Deuxième forme normale (2NF) : S’appuie sur la 1NF en éliminant les dépendances partielles. Les attributs non clés doivent dépendre de la clé primaire entière.

-

Troisième forme normale (3NF) : Élimine les dépendances transitives. Les attributs non clés doivent dépendre uniquement de la clé primaire, et non d’autres attributs non clés.

Bien que la normalisation stricte assure l’intégrité des données, elle peut entraîner une surcharge de performance en raison du nombre de jointures nécessaires. Pour les opérations de lecture à fort volume, un certain degré de dénormalisation peut s’avérer nécessaire. Cela consiste à dupliquer des données afin de réduire le besoin de jointures complexes, au prix d’un usage accru de l’espace de stockage au profit de la vitesse des requêtes.

La décision de normaliser ou de dénormaliser doit être guidée par le ratio lecture-écriture de l’application. Les systèmes fortement écriture bénéficient d’une normalisation plus élevée pour maintenir la cohérence. Les systèmes fortement lecture peuvent bénéficier de la dénormalisation afin de minimiser les opérations de jointure.

Planification de l’expansion 🚀

La scalabilité n’est pas une réflexion tardive ; elle doit être intégrée dès la conception initiale. Plusieurs décisions architecturales prises pendant la phase de modélisation ER influencent la manière dont le système gère la croissance.

-

Partitionnement : Les grandes tables doivent être conçues en tenant compte du partitionnement. Les colonnes utilisées pour le partitionnement (par exemple, région ou date) doivent être indexées et accessibles sans nécessiter de scans complets de table.

-

Mise à l’échelle horizontale : Si les données sont réparties sur plusieurs nœuds, le schéma doit prendre en charge les clés de fractionnement. Évitez d’utiliser des identifiants uniques globaux comme clé de partition unique, sauf si la répartition est uniforme.

-

Suppressions douces : Au lieu de supprimer physiquement les enregistrements, marquez-les comme inactifs. Cela préserve l’intégrité des données historiques et permet de conserver des traces d’audit sans verrouiller les lignes pendant les opérations de suppression.

En outre, prenez en compte l’impact des métadonnées. À mesure que les fonctionnalités s’élargissent, de nouveaux attributs sont fréquemment ajoutés. Évitez de coder en dur la logique dans le schéma de base de données. Utilisez des types de données flexibles ou des colonnes JSON pour les attributs pouvant varier selon le type d’entité, à condition qu’ils ne compromettent pas les performances des requêtes.

Défauts structurels courants 🚫

Même les designers expérimentés rencontrent des pièges. Identifier les défauts structurels courants tôt peut éviter un endettement technique important. Le tableau suivant décrit les problèmes fréquents et leurs conséquences.

|

Défaut |

Impact sur la croissance |

Stratégie d’atténuation |

|---|---|---|

|

Couplage étroit |

Les modifications dans une entité cassent les autres de manière inattendue. |

Utilisez un couplage lâche via des tables de jonction ou des couches d’API. |

|

Index manquants |

La latence des requêtes augmente de manière exponentielle avec le volume de données. |

Identifiez les colonnes fréquemment interrogées et indexez-les. |

|

Contraintes rigides |

Les modifications de la logique métier nécessitent des migrations de schéma. |

Déplacez la logique de validation vers la couche d’application lorsque cela est possible. |

|

Sur-normalisation |

Trop de jointures ralentissent les opérations de lecture. |

Dénormalisez des tables spécifiques pour les charges de travail intensives en lecture. |

|

Relations floues |

Les développeurs font des hypothèses erronées sur le flux de données. |

Documentez clairement la cardinalité et les règles métier. |

Processus itératif d’amélioration 🔄

Concevoir un schéma ER évolutif est rarement une opération ponctuelle. C’est un processus itératif qui évolue parallèlement au produit. La documentation est un élément essentiel de ce cycle.

-

Contrôle de version :Traitez les modifications de schéma comme du code. Utilisez des scripts de migration pour suivre les modifications dans le temps. Cela permet des fonctionnalités de retour arrière et une analyse historique.

-

Cycles de revue :Menez des revues régulières avec les parties prenantes. Assurez-vous que le modèle de données est aligné sur les objectifs commerciaux actuels et les besoins futurs prévus.

-

Tests :Simulez des scénarios de croissance. Testez la charge de la base de données avec des volumes de données reflétant les projections futures. Observez comment les relations se comportent sous contrainte.

Les boucles de retour sont essentielles. Si une requête spécifique fonctionne constamment de manière insuffisante, revenez au schéma ERD. Parfois, un léger ajustement de la relation ou de la stratégie d’index permet de résoudre le problème sans modifications architecturales majeures.

Gestion de la croissance des données 📈

Au fur et à mesure que le système mûrit, le volume de données augmente. Le schéma entité-association doit pouvoir s’adapter à cela sans compromettre l’accessibilité. Des stratégies d’archivage doivent être envisagées dès la phase de conception.

-

Données historiques :Identifiez les données qui sont moins fréquemment consultées. Concevez des partitions ou des tables spécifiquement dédiées aux enregistrements historiques afin de garder les tables actives légères.

-

Politiques de rétention :Définissez des règles de rétention des données. Le schéma doit prendre en charge des champs qui suivent automatiquement l’âge des données ou les dates d’expiration.

-

Réplication :Prévoyez des réplicas en lecture. Le schéma doit permettre des opérations en lecture seule sur les nœuds secondaires sans conflits d’intégrité des données.

Prenez en compte le coût du stockage. Le stockage de données inutiles augmente les coûts et ralentit les sauvegardes. Des audits réguliers du modèle de données aident à identifier les tables orphelines ou les attributs inutilisés pouvant être supprimés.

Sécurité et contrôle d’accès 🔒

La sécurité est souvent négligée dans la conception des schémas entité-association. Toutefois, les relations entre les données définissent les limites d’accès. Le contrôle d’accès basé sur les rôles (RBAC) doit être reflété dans la structure des données.

-

Sécurité au niveau des lignes :Concevez les tables pour supporter la sécurité au niveau des lignes. Cela garantit que les utilisateurs n’accèdent qu’aux données pertinentes pour leur rôle, sans logique d’application complexe.

-

Traçabilité des audits :Incluez des champs pour suivre qui a créé ou modifié un enregistrement. Cela est essentiel pour la conformité et le débogage des problèmes dans les systèmes complexes.

-

Classification des données :Marquez les données sensibles au sein du schéma. Cela permet aux outils automatisés d’appliquer des politiques de chiffrement ou de masquage sur des colonnes spécifiques.

En intégrant les considérations de sécurité dans le schéma, vous réduisez le risque de fuites de données et simplifiez les audits de conformité. Les relations ne doivent pas exposer des données sensibles à des entités non autorisées, même par des jointures indirectes.

Conclusion sur une architecture durable 🛡️

Construire un schéma entité-association évolutif exige un équilibre entre l’intégrité théorique et les performances pratiques. Cela demande une compréhension approfondie de la manière dont les données interagissent sous charge. En se concentrant sur des relations claires, une normalisation stratégique et des modèles de conception à long terme, les systèmes peuvent supporter la croissance sans friction.

Une maintenance régulière et une documentation adéquates garantissent que le modèle reste pertinent au fur et à mesure que les besoins métiers évoluent. Éviter les pièges courants et privilégier la sécurité dès le départ établit une base qui soutient le succès à long terme. L’objectif n’est pas seulement de stocker des données, mais de les structurer de manière à permettre à toute l’organisation de progresser efficacement.