Diseñar estructuras de datos robustas requiere un equilibrio entre la pureza teórica y el rendimiento práctico. Al trabajar con modelos de relaciones de entidades complejos (ERD), adherirse estrictamente a las reglas de normalización a menudo genera fricción en entornos de alta velocidad. Este artículo explora tácticas de denormalización estratégicas diseñadas para mejorar la eficiencia de las consultas manteniendo la integridad de los datos. Examinaremos cuándo desviarse de las formas estándar y cómo implementar la redundancia de forma segura.

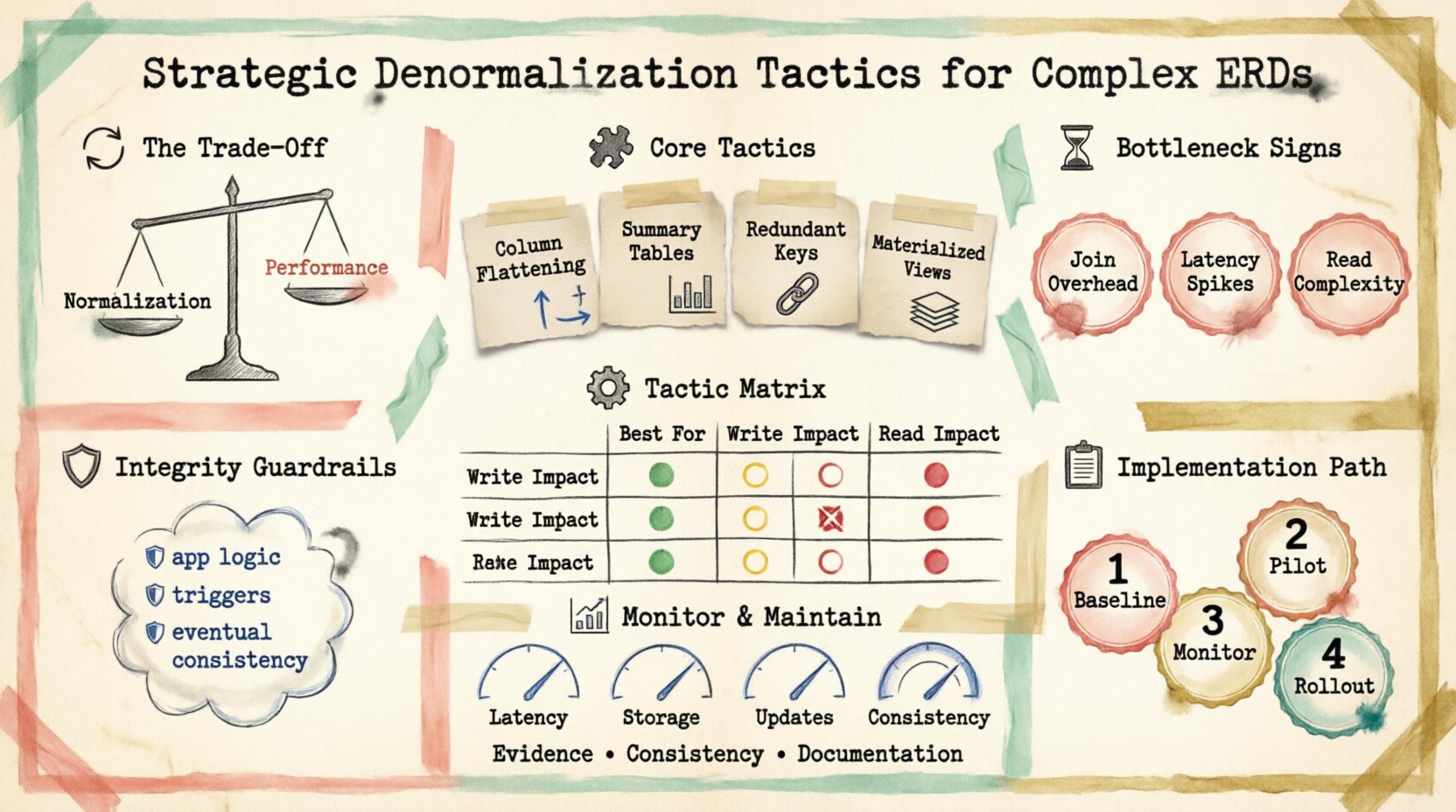

Los arquitectos de bases de datos enfrentan con frecuencia una elección entre optimizar para operaciones de escritura o de lectura. La normalización reduce la redundancia, garantizando la consistencia de los datos. Sin embargo, puede aumentar el número de uniones necesarias para la recuperación, afectando la latencia. La denormalización reintroduce la redundancia para simplificar los patrones de acceso. Este enfoque no consiste en abandonar las mejores prácticas, sino en aplicarlas allí donde la lógica del negocio lo exige.

El costo de la normalización estricta 🔄

En un estado normalizado, los datos se organizan en tablas distintas para minimizar la duplicación. Esta estructura es ideal para la eficiencia de almacenamiento y la consistencia de escritura. Sin embargo, a medida que aumenta el número de relaciones, la complejidad para recuperar un solo registro también crece.

- Sobrecarga de unión: Cada operación de unión consume recursos de CPU y memoria. Las consultas complejas que involucran cinco o más tablas pueden convertirse en cuellos de botella.

- Latencia: Los viajes de red aumentan con el número de tablas involucradas. En sistemas distribuidos, esta latencia se amplifica.

- Complejidad de lectura: La lógica de la aplicación se vuelve más compleja ya que debe coordinar múltiples pasos de recuperación de datos.

Para paneles de informes, análisis en tiempo real o interfaces de usuario donde la velocidad de lectura es crítica, el costo de la normalización puede superar sus beneficios. Comprender esta compensación es el primer paso en la optimización estratégica.

Identificación de cuellos de botella de rendimiento ⏱️

Antes de modificar el esquema, debe identificar puntos de dolor específicos. No todas las consultas lentas requieren denormalización. Utilice herramientas de perfilado para analizar los planes de ejecución.

- Alto tiempo de espera de E/S: Indica una lectura excesiva del disco, a menudo causada por escanear tablas grandes.

- Contención de bloqueos: Los bloqueos frecuentes durante las lecturas pueden indicar estructuras de datos sobrecargadas o fragmentadas.

- Consultas de agregación lentas: Los cálculos a través de múltiples tablas suelen sufrir una sobrecarga de normalización.

Cuando estas métricas aparecen de forma consistente, señalan una oportunidad para reestructurar los datos. El objetivo es reducir la carga computacional sobre el motor sin comprometer la fuente de la verdad.

Enfoques tácticos fundamentales 🧩

Existen varios métodos para introducir redundancia de forma estratégica. La elección depende de la relación de lectura a escritura de su carga de trabajo específica.

1. Aplanamiento de columnas

Esto implica mover datos de tablas relacionadas directamente a la tabla principal. Por ejemplo, almacenar la dirección de correo electrónico de un usuario dentro de la tabla de pedidos, en lugar de unir la tabla de usuarios cada vez que se recupera un pedido.

- Beneficio: Elimina la necesidad de unión para los detalles del usuario.

- Restricción: Los datos deben actualizarse cada vez que cambie el perfil del usuario.

2. Tablas de resumen

Los agregados precalculados pueden estar junto con los datos transaccionales detallados. Esto es común en informes financieros o gestión de inventarios.

- Beneficio: Acceso instantáneo a totales, promedios y conteos.

- Restricción: Requiere un mecanismo para mantener los agregados sincronizados con los datos brutos.

3. Claves foráneas redundantes

A menudo, se necesita una clave de padre en una tabla hija para búsquedas rápidas. Agregar una clave foránea redundante permite una referencia directa sin recorrer la jerarquía.

- Beneficio: Recorrido más rápido en jerarquías profundas.

- Restricción: Aumenta ligeramente el almacenamiento y requiere comprobaciones de consistencia.

Matriz de comparación de tácticas

| Táctica | Mejor para | Impacto en escritura | Impacto en lectura |

|---|---|---|---|

| Aplanamiento de columnas | Consultas con muchas búsquedas | Medio | Bajo |

| Tablas de resumen | Informes y análisis | Alto | Muy bajo |

| Claves redundantes | Jerarquías profundas | Bajo | Bajo |

| Vistas materializadas | Uniones complejas | Medio | Bajo |

Gestión de la integridad de los datos 🛡️

Introducir redundancia crea un riesgo de divergencia de datos. Si los datos de origen cambian y la copia redundante no, el sistema se vuelve poco confiable. Este es el principal desafío de la denormalización.

- Lógica a nivel de aplicación: Asegúrese de que el código actualice todas las copias de los datos dentro de una sola transacción.

- Disparadores: Los disparadores de base de datos pueden automatizar las actualizaciones de los campos redundantes cuando cambian las tablas de origen.

- Consistencia eventual: En algunos sistemas, pequeños retrasos entre las actualizaciones son aceptables. Esto reduce la carga, pero requiere que la aplicación maneje los datos obsoletos de forma adecuada.

Las reglas de validación son esenciales. Las auditorías periódicas deben comparar los datos de origen con las copias redundantes para detectar desviaciones. Si se encuentra una discrepancia, se debe ejecutar un script de reconciliación para restaurar la consistencia.

Estrategia de implementación 📋

No refactorice toda la base de datos de una vez. Adopte un enfoque por fases para minimizar el riesgo.

- Medición de referencia: Registre los tiempos actuales de consulta y el uso de recursos.

- Denormalización piloto: Seleccione una consulta de alto impacto y optimícela.

- Monitoreo: Monitoree las mejoras de rendimiento y los errores de consistencia de datos.

- Despliegue: Extienda el patrón a otras áreas de alto volumen.

La documentación es crítica. Marque claramente qué tablas están denormalizadas y por qué. Los desarrolladores futuros necesitan comprender las compensaciones realizadas en el diseño del esquema.

Monitoreo de métricas de rendimiento 📊

Una vez que la denormalización está activa, el monitoreo continuo asegura que la estrategia siga siendo efectiva.

- Latencia de consulta: Vigile los aumentos que podrían indicar contención de bloqueos en las tablas actualizadas.

- Crecimiento del almacenamiento: Los datos redundantes consumen más espacio. Planifique la capacidad en consecuencia.

- Frecuencia de actualización: Los altos volúmenes de escritura en tablas denormalizadas pueden degradar el rendimiento.

- Errores de consistencia:Registre cualquier falla en el proceso de sincronización.

Se deben configurar alertas para anomalías. Si una tabla específica crece más rápido de lo esperado, podría indicar un error lógico en la forma en que se está replicando los datos.

Protocolos de mantenimiento 🔧

Mantener un esquema desnormalizado requiere disciplina. No es una configuración de poner y olvidar.

- Versionado de esquemas:Trate los cambios de esquema como código. Revise los scripts de migración con regularidad.

- Rutinas de limpieza:Elimine los datos redundantes que ya no son necesarios para ahorrar espacio.

- Frecuencia de revisión:Revalúe la necesidad de desnormalización a medida que cambian los requisitos del negocio.

A veces, la optimización inicial ya no es necesaria si el volumen de datos disminuye o cambian los patrones de acceso. Las revisiones regulares evitan que se acumule deuda técnica.

Frecuencia estratégica de revisión 🔄

El diseño de bases de datos no es estático. Lo que funciona hoy puede no funcionar mañana. Programa revisiones trimestrales del modelo de entidad-relación.

- Análisis de carga:¿Ha cambiado la proporción de lecturas frente a escrituras?

- Actualizaciones de hardware:Nueva tecnología de almacenamiento podría cambiar el costo de las uniones.

- Objetivos del negocio:Nuevas funciones podrían requerir estructuras de datos diferentes.

La flexibilidad es clave. Esté preparado para volver a normalizar si el costo de mantener la redundancia supera las ganancias de rendimiento. El objetivo siempre es un comportamiento óptimo del sistema, no la adherencia a un dogma de diseño específico.

Pensamientos finales sobre la evolución de esquemas 📝

La desnormalización es una herramienta poderosa en el kit del arquitecto de bases de datos. Aborda problemas reales de rendimiento que los modelos teóricos a veces pasan por alto. Al aplicar estas tácticas de manera metódica, puede construir sistemas que sean rápidos y confiables.

- Enfóquese en la evidencia:Base sus decisiones en métricas, no en suposiciones.

- Priorice la consistencia:Asegúrese de que los datos permanezcan precisos en todas las capas.

- Documente las decisiones:Mantenga un registro de por qué se modificaron tablas específicas.

Con una planificación cuidadosa y un mantenimiento continuo, los modelos de entidad-relación complejos pueden ofrecer el rendimiento requerido por las aplicaciones modernas. El camino hacia la eficiencia es iterativo, requiriendo atención constante al equilibrio entre estructura y velocidad.