La arquitectura de su sistema de almacenamiento de datos suele ser invisible para el usuario final, pero determina la reactividad de cada interacción. Cuando un usuario hace clic en un botón, el recorrido desde esa acción hasta la retroalimentación visual depende en gran medida de la rapidez con la que el motor de base de datos subyacente puede recuperar y procesar la información. Esta velocidad, conocida como latencia, no es meramente una función de la capacidad de hardware o del ancho de banda de red. Está fundamentalmente arraigada en el diseño de la estructura de datos misma.

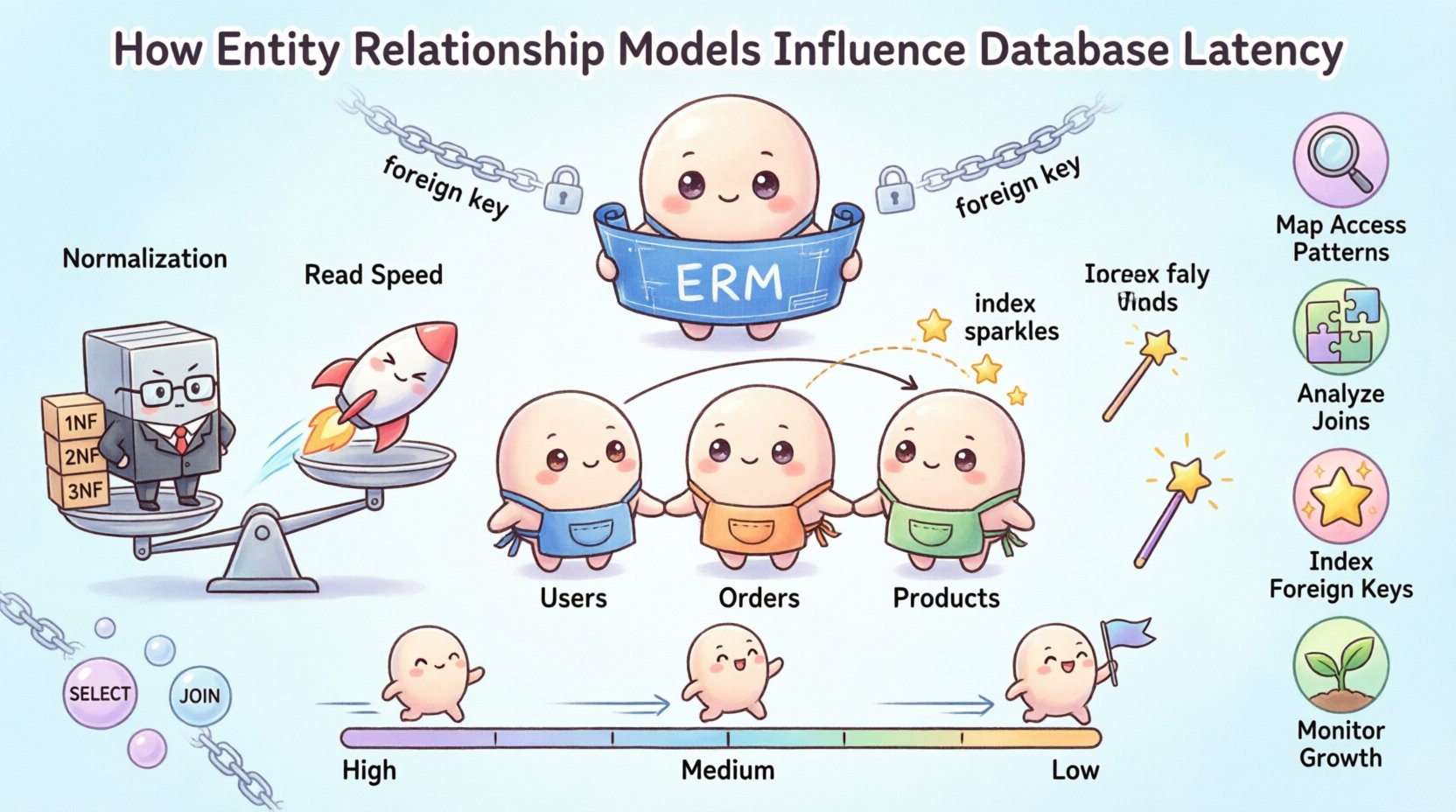

El modelo de relación de entidades (ERM) sirve como plano directriz para esta estructura. Define cómo se almacenan las entidades, cómo se relacionan entre sí y cómo las restricciones unen los datos. Un modelo mal concebido puede introducir fricción innecesaria, haciendo que las consultas recorran más bloques de disco de los necesarios o obligando al procesador a realizar uniones complejas que ralentizan el sistema. Por el contrario, un modelo bien optimizado anticipa los patrones de acceso y alinea las estructuras de almacenamiento con los requisitos de consulta.

🏗️ La relación fundamental entre el esquema y la velocidad

La latencia en un entorno de base de datos se mide típicamente en milisegundos o microsegundos. Aunque un solo milisegundo puede parecer insignificante, en sistemas de alta capacidad, estos retrasos se acumulan rápidamente. El diagrama de relación de entidades (ERD) actúa como el plan lógico para el almacenamiento físico. Cada línea que conecta dos entidades representa una operación de unión potencial. Cada atributo dentro de una entidad representa una columna que debe escanearse o indexarse.

Cuando los desarrolladores diseñan un ERM, toman decisiones que afectan directamente el plan de ejecución elegido por el motor de base de datos. El motor depende de los metadatos derivados de este modelo para determinar el camino más eficiente hacia los datos. Si el modelo sugiere una estructura altamente normalizada, el motor puede necesitar realizar múltiples búsquedas para reconstruir un registro completo. Esto aumenta el número de operaciones de E/S necesarias.

- Diseño lógico: Define claramente las relaciones y las restricciones.

- Implementación física: Traduce el diseño lógico en estructuras de almacenamiento reales.

- Ejecución de consultas: Depende de los metadatos proporcionados por el esquema.

Comprender esta cadena es crucial. Un cambio en el modelo lógico puede propagarse a través de la capa física, alterando cómo se almacena en caché la data, cómo se construyen los índices y cómo se bloquean las transacciones. El objetivo es equilibrar la integridad de los datos con la eficiencia de recuperación.

📉 Compromisos entre normalización y latencia

La normalización es el proceso de organizar los datos para reducir la redundancia. Aunque esto garantiza la consistencia, a menudo conlleva un costo en el rendimiento de lectura. Las formas estándar de normalización (1FN, 2FN, 3FN) empujan los datos hacia tablas más pequeñas y específicas. Para recuperar una vista completa de una entidad, el sistema debe unir estas tablas.

Considere un escenario en el que los detalles de los pedidos de clientes se almacenan en tablas separadas. Recuperar un historial completo de pedidos requiere unir las tablasClientes, Pedidos, yElementos de pedido tablas. Cada unión introduce una sobrecarga de CPU y E/S de disco. Si el motor de base de datos no puede utilizar un índice de forma eficaz, puede recurrir a un escaneo completo de la tabla, aumentando drásticamente la latencia.

Principales impactos de la normalización

- Reducción de redundancia: Se requiere menos espacio de almacenamiento para valores repetidos.

- Consistencia: Las actualizaciones ocurren en un solo lugar, reduciendo anomalías.

- Aumento de uniones: Las consultas complejas requieren más recursos computacionales.

- Fragmentación: Los datos se distribuyen en más páginas, lo que podría aumentar el tiempo de búsqueda.

Para aplicaciones con alta carga de escritura, la normalización suele ser beneficiosa. Reduce la cantidad de datos escritos por transacción. Sin embargo, para cargas de trabajo con alta demanda de lectura, el costo de reconstruir los datos puede convertirse en un cuello de botella. La decisión de normalizar o denormalizar depende completamente de los patrones específicos de acceso de la aplicación.

🔗 Complejidad de las uniones y planes de ejecución

La complejidad de las relaciones definidas en el DER influye directamente en la complejidad de las uniones. Un motor de base de datos analiza el grafo de tablas y relaciones para determinar el orden en que procesar las uniones. En un esquema plano, esto es trivial. En un esquema altamente relacional, el motor debe calcular el orden de unión más eficiente.

Cuando el modelo incluye relaciones muchos a muchos, el sistema introduce típicamente una tabla de enlace. Esto añade una capa adicional de indirección. Cada vez que consultas a través de estas relaciones, el motor debe resolver el enlace. Si las claves foráneas que definen estos enlaces no están indexadas, la búsqueda se convierte en una búsqueda lineal, lo cual es computacionalmente costoso.

Tipos de unión y rendimiento

| Tipo de unión | Impacto en la latencia | Casos de uso |

|---|---|---|

| Unión interna | Bajo a medio | Recuperando solo los registros que coinciden. |

| Unión izquierda/derecha | Medio | Recuperando todos los registros de un lado, coincidiendo con el otro. |

| Unión cruzada | Alto | Productos cartesianos; rara vez utilizados en producción. |

| Unión consigo misma | Alto | Uniendo una tabla consigo misma para datos jerárquicos. |

Minimizar el uso de uniones complejas es una estrategia principal para reducir la latencia. Esto a menudo implica replantear el DER para aplanar los datos cuando sea apropiado. Sin embargo, esto debe hacerse sin comprometer la integridad lógica del modelo de datos.

📎 Estrategias de indexación basadas en el DER

El DER determina dónde deben colocarse los índices. Las claves foráneas son el candidato más común para el indexado. Cuando una tabla hace referencia a otra, la columna de relación se convierte en una ruta de búsqueda crítica. Sin un índice en esta clave foránea, cada actualización en la tabla padre requiere un escaneo de la tabla hija para verificar violaciones de restricciones.

Además, la cardinalidad de la relación afecta la estrategia de indexación. Una relación uno a muchos sugiere que el índice en el lado muchos (la tabla hija) tendrá muchos valores duplicados. Una relación muchos a muchos implica una tabla de unión que requiere índices compuestos para funcionar de manera eficiente.

- Claves primarias:Siempre indexadas para una identificación rápida de filas.

- Claves foráneas:Críticas para el rendimiento de las uniones y el cumplimiento de restricciones.

- Claves compuestas: Útil para consultas que filtran en múltiples columnas.

- Índices cubrientes:Incluye todos los datos necesarios para una consulta, para evitar búsquedas en tablas.

El sobreíndice también es un riesgo. Cada índice consume almacenamiento y ralentiza las operaciones de escritura porque la base de datos debe actualizar la estructura del índice junto con los datos. El diagrama ER ayuda a identificar qué relaciones se consultan con frecuencia, guiando la colocación de estos índices.

⚙️ Restricciones de clave foránea y latencia de escritura

Aunque las claves foráneas garantizan la integridad de los datos, introducen sobrecarga durante las operaciones de escritura. Al insertar o actualizar un registro, la base de datos debe verificar que el registro referenciado exista. Este proceso de verificación tarda tiempo.

En un sistema con integridad referencial estricta, cada restricción de clave foránea añade una verificación. Si la tabla referenciada es grande, esta verificación puede convertirse en un cuello de botella. Además, las eliminaciones en cascada pueden desencadenar una cadena de eliminaciones a través de múltiples tablas, bloqueando recursos durante períodos prolongados.

Consideraciones sobre escritura frente a lectura

- Sistemas con carga pesada de lectura:Pueden tolerar una integridad ligeramente menor para obtener uniones más rápidas.

- Sistemas con carga pesada de escritura:Se benefician de eliminar restricciones o usar validación a nivel de aplicación.

- Eliminaciones en cascada: Deben usarse con moderación para evitar tormentas de bloqueo.

Algunas arquitecturas optan por garantizar la integridad a nivel de la aplicación en lugar de a nivel de la base de datos. Esto desplaza la carga de latencia hacia la aplicación, pero puede mejorar el rendimiento de la base de datos. Sin embargo, esto requiere un código de aplicación robusto para prevenir la corrupción de datos.

🔄 Estrategias de denormalización

Cuando el modelo entidad-relación genera demasiados saltos para consultas comunes, la denormalización se convierte en una solución viable. Esto implica introducir deliberadamente redundancia en el esquema para reducir la necesidad de uniones. Por ejemplo, almacenar el nombre de un cliente directamente en la tabla de pedidos evita una unión con la tabla de clientes.

Esta técnica reduce significativamente la latencia de lectura. Los datos están físicamente ubicados juntos, lo que significa que pueden leerse desde un solo bloque de disco. Sin embargo, introduce complejidad al mantener la consistencia. Si un cliente cambia su nombre, cada registro de pedido que contenga ese nombre debe actualizarse.

Cuándo denormalizar

- Paneles de informes:Los almacenes de datos de solo lectura suelen usar esquemas denormalizados.

- Negociación de alta frecuencia:Donde los milisegundos importan más que la eficiencia de almacenamiento.

- Capas de caché:Preagregando datos en un almacén separado y denormalizado.

La decisión de denormalizar debe ser impulsada por datos. Monitorear el rendimiento de las consultas e identificar cuellos de botella proporciona la evidencia necesaria para justificar cambios en el esquema. Denormalizar ciegamente puede provocar anomalías de datos y aumentar los costos de mantenimiento.

✅ Lista de verificación de optimización

Para asegurarse de que su modelo entidad-relación soporte operaciones de baja latencia, revise los siguientes puntos durante la fase de diseño:

- Mapear patrones de acceso:Comprenda cómo los usuarios consultan los datos antes de definir las tablas.

- Analizar las rutas de unión:Minimice el número de tablas involucradas en consultas críticas.

- Indexar claves foráneas:Asegúrese de que todas las columnas de relación estén indexadas.

- Revisar la cardinalidad:Evite relaciones muchos a muchos innecesarias.

- Monitorear el crecimiento:Diseñe para el volumen futuro de datos, no solo para las necesidades actuales.

- Probar consultas:Ejecute consultas reales contra el esquema para medir el tiempo de ejecución.

- Equilibrar las restricciones:Pese el costo de las verificaciones de integridad frente a las necesidades de rendimiento.

Al tratar el ERD como una herramienta de rendimiento, y no solo como un artefacto de documentación, los equipos pueden reducir significativamente la latencia. El modelo determina la realidad física del almacenamiento de datos, y alinear ese modelo con las necesidades de la aplicación es la clave para un sistema reactivo.

🚀 Reflexiones finales sobre el rendimiento del esquema

La latencia de la base de datos es un problema multifacético que no puede resolverse solo con actualizaciones de hardware. El modelo de entidad-relación forma la base de la accesibilidad de los datos. Cada línea dibujada en un diagrama representa una ruta potencial para la recuperación de datos. Optimizar estas rutas requiere una comprensión profunda de cómo el motor de la base de datos procesa las relaciones.

Los diseñadores deben navegar la tensión entre la normalización y el rendimiento. Si bien las estructuras normalizadas ofrecen claridad e integridad, pueden introducir latencia a través de uniones. La denormalización ofrece velocidad, pero exige una mantenimiento riguroso. El equilibrio adecuado depende de la carga de trabajo específica y de la criticalidad de la consistencia de los datos.

A medida que los sistemas crecen, el costo de la ineficiencia se acumula. Un esquema diseñado para un conjunto de datos pequeño puede tener dificultades bajo carga pesada. La revisión continua del modelo asegura que la base de datos siga funcionando de manera eficiente a medida que evolucionan los requisitos. Priorizar la estructura de los datos es la forma más efectiva de controlar la latencia a largo plazo.