Die Architektur Ihres Datenspeichersystems ist für den Endbenutzer oft unsichtbar, prägt aber dennoch die Reaktionsfähigkeit jeder Interaktion. Wenn ein Benutzer auf eine Schaltfläche klickt, hängt die Reise von dieser Aktion bis zur visuellen Rückmeldung stark davon ab, wie schnell die zugrundeliegende Datenbank-Engine Informationen abrufen und verarbeiten kann. Diese Geschwindigkeit, bekannt als Latenz, ist nicht einfach eine Funktion der Hardwarekapazität oder der Netzwerkbandbreite. Sie ist grundlegend in der Gestaltung der Datenstruktur selbst verwurzelt.

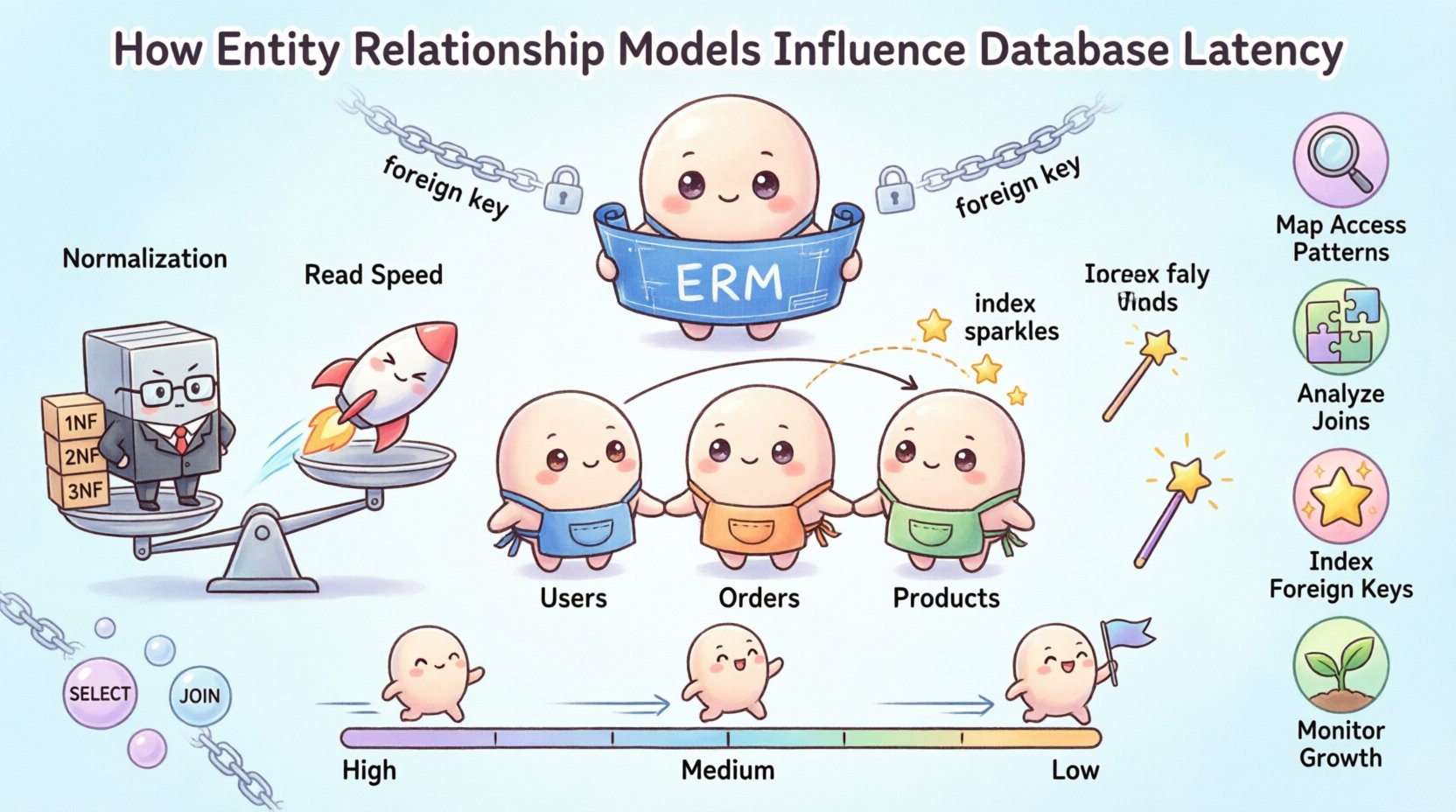

Das Entitäts-Beziehungs-Modell (ERM) dient als Bauplan für diese Struktur. Es definiert, wie Entitäten gespeichert werden, wie sie miteinander verwandt sind und wie Einschränkungen die Daten zusammenhalten. Ein schlecht durchdachtes Modell kann unnötige Reibung erzeugen, wodurch Abfragen mehr Datenträgerblöcke durchlaufen als nötig oder der Prozessor gezwungen wird, komplexe Verknüpfungen durchzuführen, die das System verlangsamen. Im Gegenteil ermöglicht ein gut optimiertes Modell die Vorhersage von Zugriffsmustern und die Ausrichtung der Speicherstrukturen an die Anforderungen der Abfragen.

🏗️ Die zentrale Beziehung zwischen Schema und Geschwindigkeit

Die Latenz in einer Datenbankumgebung wird typischerweise in Millisekunden oder Mikrosekunden gemessen. Obwohl eine einzelne Millisekunde gering erscheinen mag, summieren sich diese Verzögerungen in Systemen mit hoher Durchsatzleistung schnell auf. Das Entitäts-Beziehungs-Diagramm (ERD) fungiert als logischer Plan für die physische Speicherung. Jede Linie, die zwei Entitäten verbindet, stellt eine mögliche Verknüpfungsoperation dar. Jedes Attribut innerhalb einer Entität steht für eine Spalte, die gescannt oder indiziert werden muss.

Wenn Entwickler ein ERM entwerfen, treffen sie Entscheidungen, die direkt die vom Datenbank-Engine gewählte Ausführungsplan beeinflussen. Die Engine stützt sich auf Metadaten, die aus diesem Modell abgeleitet werden, um den effizientesten Weg zu den Daten zu bestimmen. Wenn das Modell eine stark normalisierte Struktur vorschlägt, muss die Engine möglicherweise mehrere Abfragen durchführen, um einen vollständigen Datensatz wiederherzustellen. Dies erhöht die Anzahl der erforderlichen I/O-Operationen.

- Logische Gestaltung: Definiert Beziehungen und Einschränkungen eindeutig.

- Physische Umsetzung: Übersetzt die logische Gestaltung in tatsächliche Speicherstrukturen.

- Abfrageausführung: Hängt von den Metadaten ab, die vom Schema bereitgestellt werden.

Das Verständnis dieser Kette ist entscheidend. Eine Änderung im logischen Modell kann sich durch die physische Ebene hindurch auswirken und beeinflussen, wie Daten zwischengespeichert werden, wie Indizes erstellt werden und wie Transaktionen gesperrt werden. Das Ziel besteht darin, die Datenintegrität mit der Effizienz der Abrufung zu balancieren.

📉 Normalisierung im Vergleich zu Latenz-Abwägungen

Die Normalisierung ist der Prozess der Datenorganisation zur Reduzierung von Redundanz. Während dies Konsistenz gewährleistet, kommt sie oft auf Kosten der Leseleistung. Die Standardformen der Normalisierung (1NF, 2NF, 3NF) schieben Daten in kleinere, spezifischere Tabellen. Um eine vollständige Sicht einer Entität abzurufen, muss das System diese Tabellen miteinander verknüpfen.

Betrachten Sie eine Situation, in der Kundenauftragsdetails in separaten Tabellen gespeichert sind. Das Abrufen einer vollständigen Auftragshistorie erfordert die Verknüpfung der Tabellen Kunden, Aufträge, und AuftragspositionenTabellen. Jede Verknüpfung führt zu CPU-Aufwand und Datenträger-I/O. Wenn die Datenbank-Engine einen Index nicht effektiv nutzen kann, könnte sie auf eine vollständige Tabellensuche zurückgreifen, was die Latenz erheblich erhöht.

Wichtige Auswirkungen der Normalisierung

- Geringere Redundanz: Weniger Speicherplatz wird für wiederholte Werte benötigt.

- Konsistenz: Aktualisierungen erfolgen an einer Stelle, wodurch Anomalien reduziert werden.

- Mehr Verknüpfungen:Komplexe Abfragen erfordern mehr Rechenressourcen.

- Fragmentierung:Daten sind auf mehrere Seiten verteilt, was die Suchzeit potenziell erhöhen kann.

Für anwendungsintensive Schreibvorgänge ist Normalisierung oft vorteilhaft. Sie reduziert die Menge an Daten, die pro Transaktion geschrieben werden. Für Leseintensive Workloads kann jedoch die Kosten für die Rekonstruktion von Daten zu einer Engstelle werden. Die Entscheidung, zu normalisieren oder zu denormalisieren, hängt vollständig von den spezifischen Zugriffsmustern der Anwendung ab.

🔗 Verknüpfungskomplexität und Ausführungspläne

Die Komplexität der in der ERD definierten Beziehungen beeinflusst direkt die Verknüpfungscomplexität. Eine Datenbankengine analysiert den Graphen aus Tabellen und Beziehungen, um die Reihenfolge zu bestimmen, in der die Verknüpfungen verarbeitet werden sollen. Bei einem flachen Schema ist dies trivial. Bei einem hochgradig relationalen Schema muss die Engine die effizienteste Verknüpfungsreihenfolge berechnen.

Wenn das Modell viele-zu-viele-Beziehungen enthält, führt das System typischerweise eine Verknüpfungstabelle ein. Dies fügt eine zusätzliche Schicht der Indirektheit hinzu. Jedes Mal, wenn Sie über diese Beziehungen abfragen, muss die Engine die Verknüpfung auflösen. Wenn die Fremdschlüssel, die diese Verknüpfungen definieren, nicht indiziert sind, wird die Suche zu einer linearen Suche, die rechnerisch kostspielig ist.

Verknüpfungstypen und Leistung

| Verknüpfungstyp | Einfluss auf die Latenz | Anwendungsfall |

|---|---|---|

| Inner Join | Niedrig bis mittel | Es werden nur übereinstimmende Datensätze abgerufen. |

| Left/Right Join | Mittel | Alle Datensätze einer Seite werden abgerufen, die Übereinstimmungen werden von der anderen Seite hergestellt. |

| Cross Join | Hoch | Kartesische Produkte; selten in der Produktion verwendet. |

| Self Join | Hoch | Verknüpfung einer Tabelle mit sich selbst für hierarchische Daten. |

Die Minimierung des Einsatzes komplexer Verknüpfungen ist eine primäre Strategie zur Reduzierung der Latenz. Dies erfordert oft eine Neubetrachtung der ERD, um Daten dort zu flachlegen, wo dies angemessen ist. Dies muss jedoch geschehen, ohne die logische Integrität des Datenmodells zu beeinträchtigen.

📎 Indizierungsstrategien basierend auf der ERD

Die ERD legt fest, wo Indizes platziert werden sollten. Fremdschlüssel sind der häufigste Kandidat für Indizierung. Wenn eine Tabelle auf eine andere verweist, wird die Beziehungsspalte zu einem kritischen Abfragepfad. Ohne einen Index auf diesen Fremdschlüssel erfordert jeder Update-Vorgang in der übergeordneten Tabelle eine Suche in der untergeordneten Tabelle, um auf Verletzungen von Einschränkungen zu prüfen.

Darüber hinaus beeinflusst die Kardinalität der Beziehung die Indizierungsstrategie. Eine Eins-zu-Viele-Beziehung deutet darauf hin, dass der Index auf der Viele-Seite (dem Kind) viele doppelte Werte enthalten wird. Eine Viele-zu-Viele-Beziehung beinhaltet eine Verknüpfungstabelle, die zusammengesetzte Indizes erfordert, um effizient zu arbeiten.

- Primärschlüssel:Immer indiziert, um eine schnelle Zeilenidentifikation zu ermöglichen.

- Fremdschlüssel:Kritisch für die Leistung von Verknüpfungen und die Durchsetzung von Einschränkungen.

- Zusammengesetzte Schlüssel: Nützlich für Abfragen, die auf mehreren Spalten filtern.

- Deckende Indizes: Enthalten alle Daten, die für eine Abfrage benötigt werden, um Tabellen-Abfragen zu vermeiden.

Übermäßiges Indizieren ist ebenfalls ein Risiko. Jeder Index verbraucht Speicherplatz und verlangsamt Schreibvorgänge, da die Datenbank die Indexstruktur zusammen mit den Daten aktualisieren muss. Das ERD hilft dabei, welche Beziehungen häufig abgefragt werden, und leitet die Platzierung dieser Indizes an.

⚙️ Fremdschlüsselbeschränkungen und Schreiblatenz

Während Fremdschlüssel die Datenintegrität gewährleisten, führen sie bei Schreibvorgängen zu Overhead. Beim Einfügen oder Aktualisieren eines Datensatzes muss die Datenbank überprüfen, ob der referenzierte Datensatz existiert. Dieser Überprüfungsprozess dauert Zeit.

In einem System mit strenger Referenzintegrität fügt jeder Fremdschlüsselbeschränkung eine Prüfung hinzu. Wenn die referenzierte Tabelle groß ist, kann diese Prüfung zu einer Engstelle werden. Zudem können kaskadierende Löschvorgänge eine Kette von Löschvorgängen über mehrere Tabellen auslösen und Ressourcen über längere Zeiträume sperren.

Schreib- gegenüber Leseüberlegungen

- Leseintensive Systeme: Können geringfügig weniger Integrität tolerieren, um schnellere Verknüpfungen zu ermöglichen.

- Schreibintensive Systeme: Profitieren von der Entfernung von Beschränkungen oder der Verwendung von Validierung auf Anwendungsebene.

- Kaskadierende Löschvorgänge: Sollten sparsam eingesetzt werden, um Sperrstürme zu vermeiden.

Einige Architekturen entscheiden sich dafür, die Integrität auf der Anwendungsebene statt auf der Datenbankebene durchzusetzen. Dies verlagert die Latenzlast auf die Anwendung, kann aber die Durchsatzleistung der Datenbank verbessern. Dafür ist jedoch robuste Anwendungscode erforderlich, um Datenkorruption zu verhindern.

🔄 Taktiken zur De-Normalisierung

Wenn das ERM bei häufigen Abfragen zu viele Verknüpfungen erzeugt, wird die De-Normalisierung zu einer praktikablen Lösung. Dabei wird absichtlich Redundanz in das Schema eingeführt, um die Notwendigkeit von Joins zu reduzieren. Zum Beispiel vermeidet das Speichern des Namens eines Kunden direkt in der Bestellungs-Tabelle einen Join mit der Kunden-Tabelle.

Diese Technik reduziert die Lese-Latenz erheblich. Die Daten sind physisch zusammengelegt, was bedeutet, dass sie aus einem einzigen Datenträgerblock gelesen werden können. Allerdings führt sie zu Komplexität bei der Aufrechterhaltung der Konsistenz. Wenn ein Kunde seinen Namen ändert, muss jeder Bestellungsdatensatz, der diesen Namen enthält, aktualisiert werden.

Wann man de-normalisieren sollte

- Berichts-Interfaces:Schreibgeschützte Datenlager verwenden häufig de-normalisierte Schemata.

- Hochfrequenzhandel: Wo Millisekunden wichtiger sind als Speichereffizienz.

- Caching-Ebenen:Voraggregieren von Daten in einem separaten, de-normalisierten Speicher.

Die Entscheidung zur De-Normalisierung sollte datengestützt sein. Die Überwachung der Abfrageleistung und die Identifizierung von Engpässen liefert die Beweise, die zur Rechtfertigung von Schemaänderungen benötigt werden. Blindes De-Normalisieren kann zu Datenanomalien und erhöhten Wartungskosten führen.

✅ Optimierungs-Checkliste

Um sicherzustellen, dass Ihr Entitäts-Beziehungs-Modell niedrige Latenzoperationen unterstützt, überprüfen Sie während der Entwurfsphase die folgenden Punkte:

- Zugriffsmuster abbilden:Verstehen Sie, wie Benutzer die Daten abfragen, bevor Sie Tabellen definieren.

- Analyse von Join-Pfaden:Minimieren Sie die Anzahl der Tabellen, die an kritischen Abfragen beteiligt sind.

- Fremdschlüssel indizieren:Stellen Sie sicher, dass alle Beziehungsspalten indiziert sind.

- Überprüfen Sie die Kardinalität:Vermeiden Sie unnötige viele-zu-viele-Beziehungen.

- Überwachen Sie das Wachstum:Gestalten Sie für zukünftige Datenmengen, nicht nur für aktuelle Anforderungen.

- Abfragen testen:Führen Sie tatsächliche Abfragen gegen das Schema aus, um die Ausführungszeit zu messen.

- Gewichtung von Einschränkungen:Gewichten Sie die Kosten von Integritätsprüfungen gegenüber den Leistungsanforderungen.

Indem man das ERD nicht nur als Dokumentationswerkzeug, sondern als Leistungsinstrument behandelt, können Teams die Latenz erheblich reduzieren. Das Modell bestimmt die physische Realität der Datenhaltung, und die Ausrichtung dieses Modells an den Anwendungsanforderungen ist der Schlüssel für ein reaktionsschnelles System.

🚀 Letzte Überlegungen zur Schema-Leistung

Datenbank-Latenz ist ein vielschichtiges Problem, das nicht allein durch Hardware-Updates gelöst werden kann. Das Entity-Relationship-Modell bildet die Grundlage für die Datenzugänglichkeit. Jede Linie, die in einem Diagramm gezeichnet wird, stellt einen potenziellen Pfad für die Datenabrufung dar. Die Optimierung dieser Pfade erfordert ein tiefes Verständnis dafür, wie der Datenbank-Engine Beziehungen verarbeitet.

Designer müssen die Spannung zwischen Normalisierung und Leistung bewältigen. Während normalisierte Strukturen Klarheit und Integrität bieten, können sie durch Joins Latenz verursachen. Die Denormalisierung bietet Geschwindigkeit, erfordert aber eine strenge Wartung. Das richtige Gleichgewicht hängt von der spezifischen Arbeitslast und der Kritikalität der Datenkonsistenz ab.

Je größer die Systeme werden, desto höher wird die Kosten der Ineffizienz. Ein Schema, das für eine kleine Datenmenge entworfen wurde, kann unter hoher Last Schwierigkeiten haben. Eine kontinuierliche Überprüfung des Modells stellt sicher, dass die Datenbank auch bei sich ändernden Anforderungen effizient arbeitet. Die Priorisierung der Datenstruktur ist der effektivste Weg, um die Latenz langfristig zu steuern.