Die Datenarchitektur bildet das Rückgrat jedes robusten digitalen Systems. Wenn eine Anwendung skaliert, muss die zugrundeliegende Struktur sich weiterentwickeln, um erhöhte Last, Komplexität und Volumen zu bewältigen. Ein Entitäts-Beziehungs-Diagramm (ERD) ist mehr als eine statische Karte; es ist ein strategisches Bauplan, der festlegt, wie Informationen fließen, miteinander verknüpft sind und innerhalb einer Datenbank persistieren. Das Gestalten für Wachstum erfordert Weitsicht, um sicherzustellen, dass das Schema zukünftige Anforderungen aufnehmen kann, ohne eine vollständige Neugestaltung zu erfordern.

Ein schlecht konstruiertes Modell führt zu Engpässen, langsamer Abfrageleistung und starren Beschränkungen, die die Entwicklungsrate behindern. Im Gegenteil unterstützt ein gut gestaltetes ERD Flexibilität, Integrität und Effizienz. Diese Anleitung untersucht die wesentlichen Prinzipien zur Erstellung von Datenmodellen, die der Zeit und der Expansion standhalten.

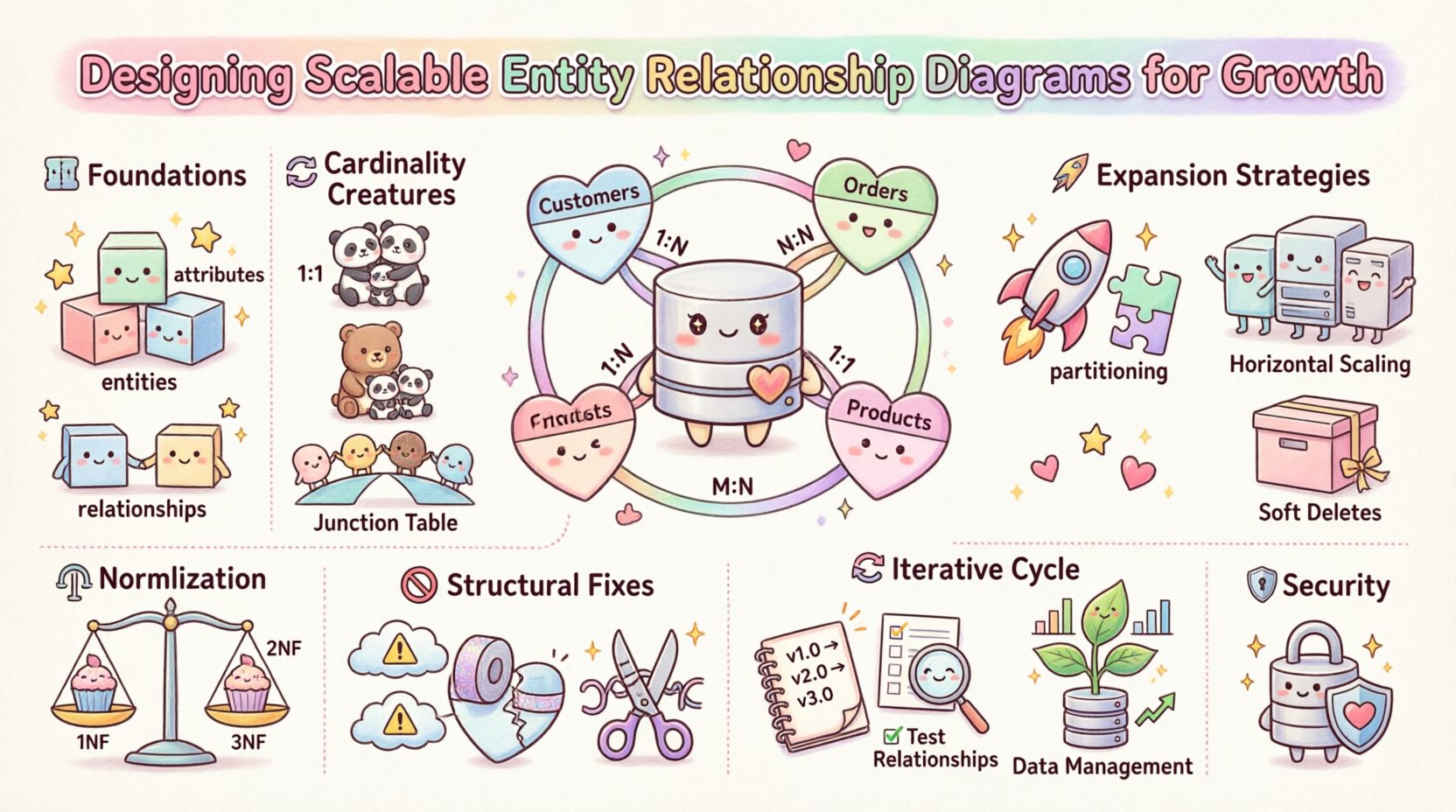

Grundlagen der Entitätsmodellierung 🏗️

Bevor man sich mit Skalierbarkeit befasst, muss man die zentralen Komponenten verstehen. Ein Entitäts-Beziehungs-Diagramm visualisiert die Struktur von Daten über drei Hauptelemente: Entitäten, Attribute und Beziehungen.

-

Entitäten: Diese stellen Objekte oder Konzepte innerhalb des Systems dar, wie zum Beispiel eine Benutzer, Produkt, oder Bestellung. In einer physischen Datenbank entsprechen Entitäten Tabellen.

-

Attribute: Diese sind die spezifischen Eigenschaften, die eine Entität beschreiben, wie zum Beispiel ein Benutzername, Preis, oder Erstellungsdatum. Attribute bestimmen die Feinheit der Datenspeicherung.

-

Beziehungen: Diese definieren, wie Entitäten miteinander interagieren. Eine Beziehung legt die Logik fest, die eine Entität mit einer anderen verbindet, oft über Fremdschlüssel.

Klarheit in diesen Definitionen verhindert Mehrdeutigkeit während der Entwicklung. Jedes Feld muss eine eindeutige Funktion haben, und jede Beziehung muss einer logischen Geschäftsregel dienen. Mehrdeutigkeit in der Entwurfsphase führt oft zu kostspieligen Umgestaltungen später.

Kardinalität und Vielfachheit 🔄

Das Verständnis der Kardinalität von Beziehungen ist entscheidend für die Skalierbarkeit. Die Kardinalität definiert die Anzahl der Instanzen einer Entität, die mit jeder Instanz einer anderen Entität assoziiert sein können oder müssen. Eine falsche Interpretation führt zu ineffizienter Speicherung und komplexen Abfragen.

-

Ein-zu-eins (1:1): Eine Zeile in Tabelle A steht genau mit einer Zeile in Tabelle B in Beziehung. Dies ist selten in Systemen mit hoher Belastung, aber nützlich, um sensible Daten oder optionale Attribute zu trennen, um die Tabellenbreite zu reduzieren.

-

Ein-zu-viele (1:N): Eine einzelne Zeile in Tabelle A steht mit mehreren Zeilen in Tabelle B in Beziehung. Dies ist die häufigste Beziehung, wie zum Beispiel eine Kunde mit vielen Bestellungen.

-

Viele-zu-viele (M:N): Datensätze in Tabelle A beziehen sich auf mehrere Datensätze in Tabelle B und umgekehrt. Hierfür ist eine Verbindungstabelle erforderlich, um sie in zwei ein-zu-viele-Beziehungen zur Implementierung aufzulösen.

Bei wachsendem Datenvolumen können Viele-zu-viele-Beziehungen zu Leistungsengpässen werden. Die Verbindungstabelle muss sorgfältig indiziert werden, um sicherzustellen, dass Abfragen die Systemgeschwindigkeit nicht beeinträchtigen. Entwickler sollten prüfen, ob eine Viele-zu-viele-Beziehung durch Einführung eines intermediären Konzepts in eine Ein-zu-viele-Struktur vereinfacht werden kann.

Normalisierungsstrategien für Leistung ⚖️

Die Normalisierung ist der Prozess der Datenorganisation zur Reduzierung von Redundanz und Verbesserung der Integrität. Obwohl sie oft als statische Regel betrachtet wird, beeinflusst das gewählte Maß an Normalisierung direkt die Skalierbarkeit.

-

Erste Normalform (1NF): Stellt atomare Werte sicher. Jede Spalte enthält nur einen Wert und beseitigt wiederholte Gruppen.

-

Zweite Normalform (2NF): Baut auf 1NF auf, indem partielle Abhängigkeiten entfernt werden. Nicht-Schlüsselattribute müssen sich auf den gesamten Primärschlüssel beziehen.

-

Dritte Normalform (3NF): Beseitigt transitive Abhängigkeiten. Nicht-Schlüsselattribute dürfen sich nur auf den Primärschlüssel beziehen, nicht auf andere Nicht-Schlüsselattribute.

Während eine strenge Normalisierung die Datenintegrität gewährleistet, kann sie aufgrund der Anzahl erforderlicher Joins zu Leistungsüberhead führen. Bei hochvolumigen Leseoperationen könnte eine gewisse Denormalisierung notwendig sein. Dabei wird Datenwiederholung eingesetzt, um komplexe Joins zu reduzieren, wobei Speicherplatz gegen Abfragegeschwindigkeit getauscht wird.

Die Entscheidung, zu normalisieren oder zu denormalisieren, sollte vom Lese-zu-Schreib-Verhältnis der Anwendung bestimmt werden. Schreibintensive Systeme profitieren von höherer Normalisierung zur Aufrechterhaltung der Konsistenz. Leseintensive Systeme könnten von einer Denormalisierung profitieren, um Joins zu minimieren.

Planung für Expansion 🚀

Skalierbarkeit ist kein Nachtrag; sie muss in die ursprüngliche Gestaltung integriert werden. Mehrere architektonische Entscheidungen, die in der ERD-Phase getroffen werden, beeinflussen, wie das System Wachstum bewältigt.

-

Partitionierung: Große Tabellen sollten mit der Partitionierung im Blick entworfen werden. Spalten, die für die Partitionierung verwendet werden (z. B. Region oder Datum), sollten indiziert und ohne vollständige Tabellen-Scans zugänglich sein.

-

Horizontales Skalieren: Wenn Daten über mehrere Knoten verteilt sind, muss das Schema Sharding-Schlüssel unterstützen. Vermeiden Sie, globale eindeutige Bezeichner als einzigen Partitionsschlüssel zu verwenden, es sei denn, die Verteilung ist gleichmäßig.

-

Weiche Löschungen: Anstatt Datensätze physisch zu löschen, markieren Sie sie als inaktiv. Dadurch bleibt die Integrität historischer Daten erhalten und es können Audits durchgeführt werden, ohne dass Zeilen während des Löschvorgangs gesperrt werden.

Zusätzlich sollten Sie die Auswirkungen von Metadaten berücksichtigen. Wenn Funktionen erweitert werden, werden häufig neue Attribute hinzugefügt. Vermeiden Sie das Festcodieren von Logik in der Datenbankschema. Verwenden Sie flexible Datentypen oder JSON-Spalten für Attribute, die sich je nach Entitätstyp unterscheiden können, vorausgesetzt, dass dies die Abfrageleistung nicht beeinträchtigt.

Häufige strukturelle Mängel 🚫

Selbst erfahrene Designer stoßen auf Fallstricke. Die frühzeitige Erkennung häufiger struktureller Mängel kann erhebliche technische Schulden vermeiden. Die folgende Tabelle zeigt häufige Probleme und ihre Auswirkungen auf.

|

Mangel |

Auswirkung auf das Wachstum |

Maßnahmen zur Minderung |

|---|---|---|

|

Starke Kopplung |

Änderungen an einer Entität brechen andere unerwarteterweise. |

Verwenden Sie lose Kopplung über Verbindungstabellen oder API-Ebenen. |

|

Fehlende Indizes |

Die Abfrageverzögerung steigt exponentiell mit dem Datenvolumen. |

Identifizieren Sie Spalten mit häufigen Abfragen und indizieren Sie sie. |

|

Starrer Einschränkungen |

Änderungen der Geschäftslogik erfordern Schema-Migrationen. |

Verschieben Sie die Validierungslogik, soweit möglich, in die Anwendungsschicht. |

|

Über-Normalisierung |

Zu viele Joins verlangsamen Leseoperationen. |

Denormalisieren Sie bestimmte Tabellen für Lese-lastige Workloads. |

|

Unklare Beziehungen |

Entwickler machen falsche Annahmen über den Datenfluss. |

Dokumentieren Sie Kardinalitäten und Geschäftsregeln klar. |

Iterativer Verbesserungsprozess 🔄

Die Gestaltung eines skalierbaren ERD ist selten ein einmaliger Vorgang. Es ist ein iterativer Prozess, der sich gemeinsam mit dem Produkt entwickelt. Die Dokumentation ist eine entscheidende Komponente dieses Zyklus.

-

Versionskontrolle:Behandeln Sie Schema-Änderungen wie Code. Verwenden Sie Migrations-Skripte, um Änderungen im Zeitverlauf zu verfolgen. Dadurch ist eine Rückgängigmachung und historische Analyse möglich.

-

Überprüfungszyklen:Führen Sie regelmäßige Überprüfungen mit Stakeholdern durch. Stellen Sie sicher, dass das Datenmodell den aktuellen Geschäftszielen und zukünftigen Anforderungen entspricht.

-

Testen:Simulieren Sie Wachstumsszenarien. Lasten Sie die Datenbank mit Datenvolumina, die zukünftige Prognosen widerspiegeln. Beobachten Sie, wie die Beziehungen unter Belastung funktionieren.

Feedback-Schleifen sind entscheidend. Wenn eine bestimmte Abfrage konstant schlecht abschneidet, überprüfen Sie erneut das ERD. Manchmal löst eine geringfügige Anpassung der Beziehung oder einer Indexstrategie das Problem, ohne dass umfassende architektonische Änderungen erforderlich sind.

Verwaltung des Datenwachstums 📈

Je weiter sich das System entwickelt, desto größer wird das Datenvolumen. Das ERD muss dies berücksichtigen, ohne die Zugänglichkeit zu beeinträchtigen. Archivierungsstrategien sollten bereits in der Entwurfsphase berücksichtigt werden.

-

Historische Daten:Identifizieren Sie Daten, die seltener abgerufen werden. Gestalten Sie Partitionen oder Tabellen speziell für historische Aufzeichnungen, um aktive Tabellen schlank zu halten.

-

Aufbewahrungsrichtlinien:Definieren Sie Regeln für die Datenaufbewahrung. Das Schema sollte Felder unterstützen, die das Alter der Daten oder Ablaufdaten automatisch verfolgen.

-

Replikation:Planen Sie Lesereplikate. Das Schema sollte Leseoperationen auf sekundären Knoten ohne Datenintegritätskonflikte unterstützen.

Berücksichtigen Sie die Kosten für Speicherung. Das Speichern unnötiger Daten erhöht die Kosten und verlangsamt Sicherungen. Regelmäßige Audits des Datenmodells helfen, verwaiste Tabellen oder nicht verwendete Attribute zu identifizieren, die entfernt werden können.

Sicherheit und Zugriffssteuerung 🔒

Sicherheit wird oft bei der ERD-Entwicklung übersehen. Dennoch definieren Datenbeziehungen Zugriffsgrenzen. Die rollenbasierte Zugriffssteuerung (RBAC) sollte in der Datenstruktur widergespiegelt werden.

-

Sicherheit auf Zeilenebene:Gestalten Sie Tabellen, die Sicherheit auf Zeilenebene unterstützen. Dadurch wird sichergestellt, dass Benutzer nur auf Daten zugreifen, die für ihre Rolle relevant sind, ohne komplexes Anwendungslogik.

-

Audit-Protokolle:Fügen Sie Felder hinzu, um zu verfolgen, wer einen Datensatz erstellt oder geändert hat. Dies ist entscheidend für die Einhaltung von Vorschriften und zur Fehlerbehebung in komplexen Systemen.

-

Datenklassifizierung:Markieren Sie vertrauliche Daten innerhalb des Schemas. Dadurch können automatisierte Tools Verschlüsselungs- oder Maskierungsrichtlinien für bestimmte Spalten durchsetzen.

Durch die Einbindung von Sicherheitsüberlegungen in das Diagramm verringern Sie das Risiko von Datenlecks und vereinfachen Compliance-Audits. Beziehungen sollten sensible Daten nicht unbefugten Entitäten offenlegen, selbst durch indirekte Verknüpfungen.

Schlussfolgerung zur nachhaltigen Architektur 🛡️

Die Erstellung eines skalierbaren Entity-Relationship-Diagramms erfordert ein Gleichgewicht zwischen theoretischer Integrität und praktischer Leistungsfähigkeit. Es erfordert ein tiefes Verständnis dafür, wie Daten unter Last interagieren. Durch die Fokussierung auf klare Beziehungen, strategische Normalisierung und zukunftsorientierte Gestaltungsmuster können Systeme Wachstum ohne Hindernisse bewältigen.

Regelmäßige Wartung und Dokumentation stellen sicher, dass das Modell auch bei sich ändernden Geschäftsanforderungen relevant bleibt. Durch die Vermeidung häufiger Fehler und die Priorisierung von Sicherheit von Beginn an entsteht eine Grundlage für langfristigen Erfolg. Das Ziel ist nicht nur, Daten zu speichern, sondern sie so zu strukturieren, dass die gesamte Organisation effizient voranschreiten kann.