Architektura systemu przechowywania danych jest często niewidoczna dla końcowego użytkownika, a mimo to decyduje o reaktywności każdej interakcji. Gdy użytkownik kliknie przycisk, podróż od tej akcji do wizualnej odpowiedzi zależy w dużej mierze od tego, jak szybko silnik bazy danych może pobrać i przetworzyć informacje. Ta szybkość, znana jako opóźnienie, nie jest jedynie funkcją pojemności sprzętu czy przepustowości sieci. Jest zasadniczo korzeniowa w projekcie samej struktury danych.

Model relacji encji (ERM) pełni rolę projektu dla tej struktury. Określa, jak są przechowywane encje, jak wzajemnie na siebie wpływają oraz jak ograniczenia łączą dane. Zły projekt może wprowadzać niepotrzebne tarcie, powodując, że zapytania przemieszczają się przez więcej bloków dyskowych niż wymagane, albo zmuszając procesor do wykonywania skomplikowanych łączeń, które spowalniają system. Z kolei dobrze zoptymalizowany model przewiduje wzorce dostępu i dopasowuje struktury przechowywania do wymagań zapytań.

🏗️ Kluczowa relacja między schematem a prędkością

Opóźnienie w środowisku bazy danych zwykle mierzy się w milisekundach lub mikrosekundach. Choć jedna milisekunda może się wydawać nieistotna, w systemach o wysokim przepływie te opóźnienia gromadzą się szybko. Diagram relacji encji (ERD) pełni rolę planu logicznego dla fizycznego przechowywania. Każda linia łącząca dwie encje reprezentuje potencjalną operację łączenia. Każdy atrybut w encji reprezentuje kolumnę, która musi być przeszukana lub indeksowana.

Gdy deweloperzy projektują ERM, podejmują decyzje, które bezpośrednio wpływają na plan wykonania wybrany przez silnik bazy danych. Silnik opiera się na metadanych pochodzących z tego modelu, aby określić najefektywniejszą drogę do danych. Jeśli model sugeruje bardzo znormalizowaną strukturę, silnik może wymagać wielu wyszukiwań, aby odtworzyć pełny rekord. To zwiększa liczbę wymaganych operacji wejścia/wyjścia.

- Projekt logiczny: Jasną definicję relacji i ograniczeń.

- Realizacja fizyczna: Przekształca projekt logiczny w rzeczywiste struktury przechowywania.

- Wykonywanie zapytań: Zależy od metadanych dostarczanych przez schemat.

Zrozumienie tej łańcuchowości jest kluczowe. Zmiana w modelu logicznym może się rozprzestrzenić na warstwę fizyczną, zmieniając sposób buforowania danych, sposób budowy indeksów oraz sposób blokowania transakcji. Celem jest zrównoważenie integralności danych z wydajnością pobierania.

📉 Zrównoważenie normalizacji i opóźnień

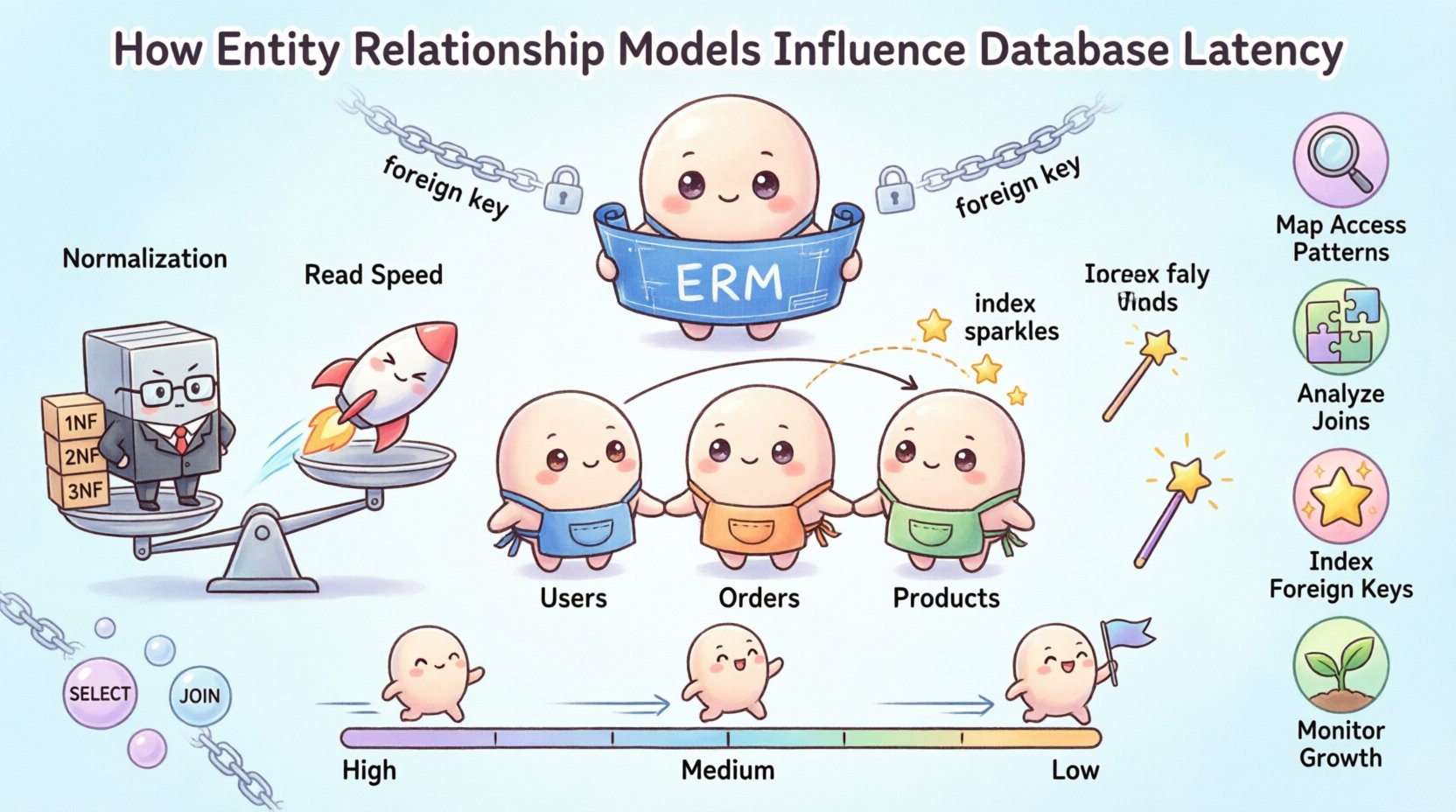

Normalizacja to proces organizowania danych w celu zmniejszenia nadmiarowości. Choć zapewnia spójność, często wiąże się z kosztem wydajności odczytu. Standardowe formy normalizacji (1NF, 2NF, 3NF) przenoszą dane do mniejszych, bardziej specyficznych tabel. Aby uzyskać pełny obraz encji, system musi połączyć te tabele.

Rozważ sytuację, w której szczegóły zamówienia klienta są przechowywane w osobnych tabelach. Pobranie pełnej historii zamówienia wymaga połączenia tabel:Klienci, Zamówienia, orazElementy zamówienia tabel. Każde łączenie wprowadza obciążenie procesora i operacje wejścia/wyjścia na dysku. Jeśli silnik bazy danych nie może skutecznie wykorzystać indeksu, może się odwołać do pełnego przeszukiwania tabeli, znacznie zwiększając opóźnienie.

Kluczowe skutki normalizacji

- Zmniejszona nadmiarowość: Mniej miejsca na dysku potrzebne dla powtarzających się wartości.

- Spójność: Aktualizacje odbywają się w jednym miejscu, zmniejszając anomalie.

- Zwiększone łączenia: Złożone zapytania wymagają większych zasobów obliczeniowych.

- Fragmentacja: Dane są rozproszone na większej liczbie stron, co potencjalnie zwiększa czas wyszukiwania.

Dla aplikacji z dużym obciążeniem zapisu, normalizacja często jest korzystna. Zmniejsza ilość danych zapisywanych w każdej transakcji. Jednak dla obciążeń o dużej liczbie odczytów koszt odtwarzania danych może stać się węzłem zatyczki. Decyzja o normalizacji lub denormalizacji zależy w pełni od konkretnych wzorców dostępu aplikacji.

🔗 Złożoność łączeń i plany wykonania

Złożoność relacji zdefiniowanych w ERD bezpośrednio wpływa na złożoność łączeń. Silnik bazy danych analizuje graf tabel i relacji, aby określić kolejność przetwarzania łączeń. W schemacie płaskim jest to trywialne. W bardzo relacyjnym schemacie silnik musi obliczyć najefektywniejszą kolejność łączeń.

Gdy model zawiera relacje wiele do wielu, system zwykle wprowadza tabelę pośrednią. Dodaje to dodatkowy poziom pośrednictwa. Każde zapytanie dotyczące tych relacji wymaga rozstrzygnięcia połączenia. Jeśli klucze obce definiujące te połączenia nie są indeksowane, wyszukiwanie staje się przeszukiwaniem liniowym, co jest obliczeniowo kosztowne.

Typy łączeń i wydajność

| Typ łączenia | Wpływ opóźnień | Przypadek użycia |

|---|---|---|

| Wewnętrzne łączenie (Inner Join) | Niski do średniego | Pobieranie tylko pasujących rekordów. |

| Łączenie lewe (Left Join) / prawe (Right Join) | Średni | Pobieranie wszystkich rekordów z jednej strony, dopasowanie z drugiej. |

| Krzyżowe łączenie (Cross Join) | Wysoki | Iloczyny kartezjańskie; rzadko używane w środowisku produkcyjnym. |

| Łączenie samodzielne (Self Join) | Wysoki | Łączenie tabeli z samą sobą w celu danych hierarchicznych. |

Minimalizacja użycia złożonych łączeń jest główną strategią zmniejszania opóźnień. Często wymaga to ponownego rozważenia ERD w celu spłaszczenia danych tam, gdzie to odpowiednie. Jednak musi to być wykonane bez naruszania integralności logicznej modelu danych.

📎 Strategie indeksowania oparte na ERD

ERD określa, gdzie powinny być umieszczone indeksy. Klucze obce są najczęściej wybieranym kandydatem do indeksowania. Gdy tabela odwołuje się do innej, kolumna relacji staje się krytycznym ścieżką wyszukiwania. Bez indeksu na tym kluczu obcym, każde aktualizowanie tabeli nadrzędnej wymaga przeszukania tabeli podrzędnej w celu sprawdzenia naruszeń ograniczeń.

Dodatkowo, liczba elementów w relacji wpływa na strategię indeksowania. Relacja jeden do wielu sugeruje, że indeks po stronie wielu (dziecka) będzie miał wiele powtórzonych wartości. Relacja wiele do wielu wymaga tabeli pośredniej, która wymaga indeksów złożonych, aby działać efektywnie.

- Klucze podstawowe: Zawsze indeksowane w celu szybkiego identyfikowania wierszy.

- Klucze obce: Kluczowe dla wydajności łączeń i zapewnienia ograniczeń.

- Klucze złożone: Użyteczne dla zapytań filtrowanych według wielu kolumn.

- Indeksy pokrywające: Zawieraj wszystkie dane potrzebne do zapytania, aby uniknąć wyszukiwań w tabeli.

Nadmiarowe indeksowanie to również ryzyko. Każdy indeks zużywa pamięć i spowalnia operacje zapisu, ponieważ baza danych musi aktualizować strukturę indeksu równocześnie z danymi. ERD pomaga zidentyfikować, które relacje są często zapytywane, kierując umiejscowieniem tych indeksów.

⚙️ Ograniczenia kluczy obcych i opóźnienie zapisu

Choć klucze obce zapewniają integralność danych, wprowadzają nadmiarową obciążenie podczas operacji zapisu. Podczas wstawiania lub aktualizowania rekordu baza danych musi zweryfikować istnienie odwoływanego rekordu. Ten proces weryfikacji zajmuje czas.

W systemie z ściśle utrzymywaną integralnością referencyjną każdy warunek klucza obcego dodaje sprawdzenie. Jeśli tabela odwołująca się jest duża, to sprawdzenie może stać się węzłem zatyczki. Dodatkowo, usuwanie kaskadowe może wywołać łańcuch usunięć przez wiele tabel, blokując zasoby przez dłuższy czas.

Rozważania dotyczące zapisu vs. odczytu

- Systemy z dużym obciążeniem odczytu: Mogą tolerować nieco mniejszą integralność dla szybszych połączeń.

- Systemy z dużym obciążeniem zapisu: Korzystają z usunięcia ograniczeń lub używania weryfikacji na poziomie aplikacji.

- Usuwanie kaskadowe: Powinny być używane oszczędnie, aby zapobiec burzom blokad.

Niektóre architektury decydują się na zapewnienie integralności na poziomie aplikacji zamiast na poziomie bazy danych. Przesuwa to obciążenie opóźnieniem na aplikację, ale może poprawić przepustowość bazy danych. Jednak wymaga to solidnego kodu aplikacji, aby zapobiec uszkodzeniu danych.

🔄 Strategie denormalizacji

Gdy ERM powoduje zbyt wiele przejść dla typowych zapytań, denormalizacja staje się realnym rozwiązaniem. Oznacza to celowe wprowadzanie nadmiarowości do schematu, aby zmniejszyć potrzebę łączeń. Na przykład przechowywanie imienia klienta bezpośrednio w tabeli zamówień uniknie łączenia z tabelą klientów.

Ta technika znacznie zmniejsza opóźnienie odczytu. Dane są fizycznie położone obok siebie, co oznacza, że mogą być odczytane z jednego bloku dysku. Jednak wprowadza złożoność w utrzymaniu spójności. Jeśli klient zmieni swoje imię, każdy rekord zamówienia zawierający to imię musi zostać zaktualizowany.

Kiedy denormalizować

- Panel raportów:Tabele danych tylko do odczytu często używają schematów denormalizowanych.

- Handel高频: Gdzie milisekundy są ważniejsze niż wydajność pamięci.

- Warstwy buforowania: Poprzednie agregowanie danych w osobnym, denormalizowanym magazynie.

Decyzja o denormalizacji powinna być oparta na danych. Monitorowanie wydajności zapytań i identyfikacja węzłów zatyczki dostarcza dowodów potrzebnych do uzasadnienia zmian schematu. Nieuzasadniona denormalizacja może prowadzić do anomalii danych i zwiększenia kosztów utrzymania.

✅ Lista kontrolna optymalizacji

Aby upewnić się, że Twój model relacji encji wspiera operacje o niskim opóźnieniu, podczas fazy projektowania przejrzyj następujące punkty:

- Mapuj wzorce dostępu: Zrozum, jak użytkownicy zapytują dane, zanim zdefiniujesz tabele.

- Analiza ścieżek połączeń:Zminimalizuj liczbę tabel zaangażowanych w krytyczne zapytania.

- Indeksuj klucze obce:Upewnij się, że wszystkie kolumny relacji są indeksowane.

- Przejrzyj liczność:Unikaj niepotrzebnych relacji wiele do wielu.

- Monitoruj wzrost:Projektuj z myślą o przyszłym objętości danych, a nie tylko o obecne potrzeby.

- Testuj zapytania:Uruchamiaj rzeczywiste zapytania względem schematu, aby zmierzyć czas wykonania.

- Zrównowaguj ograniczenia:Zważ koszt sprawdzania integralności wobec potrzeb wydajności.

Traktując ERD jako narzędzie wydajności, a nie tylko dokumentację, zespoły mogą znacząco zmniejszyć opóźnienia. Model określa rzeczywistość fizyczną przechowywania danych, a dopasowanie tego modelu do potrzeb aplikacji to klucz do reaktywnego systemu.

🚀 Ostateczne rozważania dotyczące wydajności schematu

Opóźnienie bazy danych to złożony problem, który nie może zostać rozwiązany jedynie poprzez modernizację sprzętu. Model relacji encji tworzy fundament dostępu do danych. Każda linia narysowana na schemacie reprezentuje potencjalną ścieżkę pobierania danych. Optymalizacja tych ścieżek wymaga głębokiego zrozumienia, jak silnik bazy danych przetwarza relacje.

Projektanci muszą radzić sobie z napięciem między normalizacją a wydajnością. Choć struktury znormalizowane zapewniają przejrzystość i integralność, mogą wprowadzać opóźnienia poprzez połączenia. Denormalizacja zapewnia szybkość, ale wymaga rygorystycznego utrzymania. Prawidłowa równowaga zależy od konkretnej obciążenia oraz krytyczności spójności danych.

Wraz z rozwojem systemów koszt nieefektywności się kumuluje. Schemat zaprojektowany dla małego zestawu danych może mieć trudności pod dużym obciążeniem. Ciągła analiza modelu zapewnia, że baza danych nadal działa efektywnie w miarę zmiany wymagań. Najskuteczniejszym sposobem kontroli opóźnień w długiej perspektywie jest priorytetowanie struktury danych.